নিম্নলিখিত অংশে XlaBuilder ইন্টারফেসে সংজ্ঞায়িত অপারেশনগুলির অর্থ বর্ণনা করা হয়েছে। সাধারণত, এই অপারেশনগুলি xla_data.proto তে থাকা RPC ইন্টারফেসের অপারেশনগুলির সাথে এক-একভাবে সম্পর্কিত।

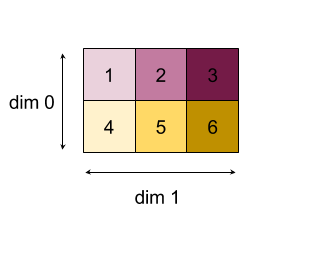

নামকরণ প্রসঙ্গে একটি টীকা: XLA যে সাধারণীকৃত ডেটা টাইপ নিয়ে কাজ করে, তা হলো একটি N-মাত্রিক অ্যারে যা কোনো একটি অভিন্ন ধরনের (যেমন ৩২-বিট ফ্লোট) উপাদান ধারণ করে। এই ডকুমেন্টেশন জুড়ে, ‘অ্যারে’ শব্দটি যেকোনো মাত্রার অ্যারে বোঝাতে ব্যবহৃত হয়েছে। সুবিধার জন্য, বিশেষ ক্ষেত্রগুলোর আরও সুনির্দিষ্ট ও পরিচিত নাম রয়েছে; উদাহরণস্বরূপ, একটি ভেক্টর হলো ১-মাত্রিক অ্যারে এবং একটি ম্যাট্রিক্স হলো ২-মাত্রিক অ্যারে।

Shapes and layout এবং Tiled Layout- এ একটি Op-এর গঠন সম্পর্কে আরও জানুন।

অ্যাবস

আরও দেখুন XlaBuilder::Abs ।

উপাদান-ভিত্তিক abs x -> |x| .

Abs(operand)

| যুক্তি | প্রকার | শব্দার্থবিদ্যা |

|---|---|---|

operand | XlaOp | ফাংশনের অপারেন্ড |

StableHLO তথ্যের জন্য StableHLO - abs দেখুন।

যোগ করুন

আরও দেখুন XlaBuilder::Add ।

lhs ও rhs প্রতিটি উপাদানের যোগফল নির্ণয় করে।

Add(lhs, rhs)

| যুক্তি | প্রকার | শব্দার্থবিদ্যা |

|---|---|---|

| বাম পাশ | XlaOp | বাম-পার্শ্বের অপারেন্ড: T টাইপের অ্যারে |

| আরএইচএস | XlaOp | বাম-পার্শ্বের অপারেন্ড: T টাইপের অ্যারে |

আর্গুমেন্টগুলোর শেপ অবশ্যই সদৃশ বা সামঞ্জস্যপূর্ণ হতে হবে। শেপ সামঞ্জস্যপূর্ণ বলতে কী বোঝায়, তা জানতে ব্রডকাস্টিং ডকুমেন্টেশন দেখুন। একটি অপারেশনের ফলাফলের শেপটি হলো দুটি ইনপুট অ্যারের ব্রডকাস্টিংয়ের ফল। এই ভ্যারিয়েন্টে, ভিন্ন র্যাঙ্কের অ্যারের মধ্যে অপারেশন সমর্থিত নয় , যদি না অপারেন্ডগুলোর মধ্যে একটি স্কেলার হয়।

Add-এর জন্য বিভিন্ন-মাত্রিক সম্প্রচার সমর্থন সহ একটি বিকল্প সংস্করণ বিদ্যমান:

Add(lhs,rhs, broadcast_dimensions)

| যুক্তি | প্রকার | শব্দার্থবিদ্যা |

|---|---|---|

| বাম পাশ | XlaOp | বাম-পার্শ্বের অপারেন্ড: T টাইপের অ্যারে |

| আরএইচএস | XlaOp | বাম-পার্শ্বের অপারেন্ড: T টাইপের অ্যারে |

| সম্প্রচার_মাত্রা | অ্যারেস্লাইস | টার্গেট শেপের কোন ডাইমেনশনের সাথে অপারেন্ড শেপের প্রতিটি ডাইমেনশন সঙ্গতিপূর্ণ |

অপারেশনটির এই রূপটি ভিন্ন র্যাঙ্কের অ্যারেগুলোর মধ্যে গাণিতিক ক্রিয়াকলাপের জন্য ব্যবহার করা উচিত (যেমন একটি ম্যাট্রিক্সের সাথে একটি ভেক্টর যোগ করা)।

অতিরিক্ত broadcast_dimensions অপারেন্ডটি হলো পূর্ণসংখ্যার একটি স্লাইস, যা অপারেন্ডগুলো ব্রডকাস্ট করার জন্য ব্যবহৃত ডাইমেনশনগুলো নির্দিষ্ট করে। এর কার্যপ্রণালী ব্রডকাস্টিং পৃষ্ঠায় বিস্তারিতভাবে বর্ণনা করা হয়েছে।

StableHLO তথ্যের জন্য StableHLO - add দেখুন।

নির্ভরতা যোগ করুন

আরও দেখুন HloInstruction::AddDependency ।

AddDependency HLO ডাম্পে দেখা যেতে পারে, কিন্তু সাধারণ ব্যবহারকারীদের দ্বারা এটি ম্যানুয়ালি তৈরি করার জন্য নয়।

সর্বোপরি

আরও দেখুন XlaBuilder::AfterAll ।

AfterAll একটি পরিবর্তনশীল সংখ্যক টোকেন গ্রহণ করে এবং একটি একক টোকেন তৈরি করে। টোকেন হলো প্রিমিটিভ টাইপ, যা ক্রম নিশ্চিত করার জন্য সাইড-ইফেক্টিং অপারেশনগুলোর মধ্যে থ্রেড করা যায়। একাধিক অপারেশনের একটি সেটের পরে কোনো একটি অপারেশনকে ক্রমানুসারে সাজানোর জন্য টোকেনগুলোর জয়েন হিসেবে AfterAll ব্যবহার করা যেতে পারে।

AfterAll(tokens)

| যুক্তি | প্রকার | শব্দার্থবিদ্যা |

|---|---|---|

tokens | XlaOp এর ভেক্টর | টোকেনের পরিবর্তনশীল সংখ্যা |

StableHLO তথ্যের জন্য StableHLO - after_all দেখুন।

অলগ্যাদার

আরও দেখুন XlaBuilder::AllGather ।

রেপ্লিকাগুলোর মধ্যে সংযোগ স্থাপন করে।

AllGather(operand, all_gather_dimension, shard_count, replica_groups, channel_id, layout, use_global_device_ids)

| যুক্তি | প্রকার | শব্দার্থবিদ্যা |

|---|---|---|

operand | XlaOp | রেপ্লিকা জুড়ে সংযুক্ত করার জন্য অ্যারে |

all_gather_dimension | int64 | সংযুক্তি মাত্রা |

shard_count | int64 | প্রতিটি প্রতিরূপ গোষ্ঠীর আকার |

replica_groups | int64 এর ভেক্টরসমূহের ভেক্টর | যে গ্রুপগুলির মধ্যে সংযোগ সম্পাদন করা হয় |

channel_id | ঐচ্ছিক ChannelHandle | আন্তঃ-মডিউল যোগাযোগের জন্য ঐচ্ছিক চ্যানেল আইডি |

layout | ঐচ্ছিক Layout | একটি লেআউট প্যাটার্ন তৈরি করে যা আর্গুমেন্টে মিলে যাওয়া লেআউটটিকে ধারণ করবে। |

use_global_device_ids | ঐচ্ছিক bool | ReplicaGroup কনফিগে থাকা আইডিগুলো যদি একটি গ্লোবাল আইডিকে প্রতিনিধিত্ব করে, তাহলে true রিটার্ন করে। |

-

replica_groupsহলো রেপ্লিকা গ্রুপগুলোর একটি তালিকা, যেগুলোর মধ্যে সংযোজন (concatenation) করা হয় (বর্তমান রেপ্লিকার আইডিReplicaIdব্যবহার করে পাওয়া যায়)। প্রতিটি গ্রুপের রেপ্লিকাগুলোর ক্রম নির্ধারণ করে যে ফলাফলে তাদের ইনপুটগুলো কোন ক্রমে থাকবে।replica_groupsঅবশ্যই হয় খালি হতে হবে (সেক্ষেত্রে সমস্ত রেপ্লিকা একটিমাত্র গ্রুপের অন্তর্ভুক্ত হবে, যা0থেকেN - 1পর্যন্ত ক্রমানুসারে সাজানো থাকবে), অথবা এতে রেপ্লিকার সংখ্যার সমান সংখ্যক উপাদান থাকতে হবে। উদাহরণস্বরূপ,replica_groups = {0, 2}, {1, 3}রেপ্লিকা0ও2এবং1ও3এর মধ্যে সংযোজন সম্পন্ন করে। -

shard_countহলো প্রতিটি রেপ্লিকা গ্রুপের আকার।replica_groupsখালি থাকলে আমাদের এটির প্রয়োজন হয়। -

channel_idআন্তঃ-মডিউল যোগাযোগের জন্য ব্যবহৃত হয়: শুধুমাত্র একইchannel_idযুক্তall-gatherঅপারেশনগুলোই একে অপরের সাথে যোগাযোগ করতে পারে। -

use_global_device_idsবিকল্পটি 'true' রিটার্ন করে যদি ReplicaGroup কনফিগারেশনের আইডিগুলো কোনো রেপ্লিকা আইডির পরিবর্তে (replica_id * partition_count + partition_id) আকারের একটি গ্লোবাল আইডিকে নির্দেশ করে। এই অল-রিডিউস প্রক্রিয়াটি যদি ক্রস-পার্টিশন এবং ক্রস-রেপ্লিকা উভয়ই হয়, তবে এটি ডিভাইসগুলোকে আরও নমনীয়ভাবে গ্রুপ করার সুযোগ দেয়।

আউটপুট শেপটি হলো ইনপুট শেপ, যেখানে all_gather_dimension shard_count গুণ বড় করা হয়। উদাহরণস্বরূপ, যদি দুটি রেপ্লিকা থাকে এবং দুটি রেপ্লিকাতেই অপারেন্ডটির মান যথাক্রমে [1.0, 2.5] এবং [3.0, 5.25] হয়, তাহলে all_gather_dim মান 0 হলে এই op থেকে প্রাপ্ত আউটপুট মান উভয় রেপ্লিকাতেই [1.0, 2.5, 3.0,5.25] হবে।

AllGather এর API অভ্যন্তরীণভাবে দুটি HLO নির্দেশাবলীতে ( AllGatherStart এবং AllGatherDone ) বিভক্ত।

আরও দেখুন HloInstruction::CreateAllGatherStart ।

AllGatherStart এবং AllGatherDone HLO-তে প্রিমিটিভ হিসেবে কাজ করে। এই অপারেশনগুলো HLO ডাম্পে দেখা যেতে পারে, কিন্তু এগুলো সাধারণ ব্যবহারকারীদের দ্বারা ম্যানুয়ালি তৈরি করার জন্য নয়।

StableHLO তথ্যের জন্য StableHLO - all_gather দেখুন।

অলরিডিউস

আরও দেখুন XlaBuilder::AllReduce ।

রেপ্লিকাগুলো জুড়ে একটি কাস্টম গণনা সম্পাদন করে।

AllReduce(operand, computation, replica_groups, channel_id, shape_with_layout, use_global_device_ids)

| যুক্তি | প্রকার | শব্দার্থবিদ্যা |

|---|---|---|

operand | XlaOp | রেপ্লিকা জুড়ে রিডিউস করার জন্য অ্যারে অথবা অ্যারের একটি অ-খালি টাপল। |

computation | XlaComputation | হ্রাস গণনা |

replica_groups | ReplicaGroup ভেক্টর | যে গোষ্ঠীগুলির মধ্যে হ্রাসগুলি সম্পাদন করা হয় |

channel_id | ঐচ্ছিক ChannelHandle | আন্তঃ-মডিউল যোগাযোগের জন্য ঐচ্ছিক চ্যানেল আইডি |

shape_with_layout | ঐচ্ছিক Shape | স্থানান্তরিত ডেটার বিন্যাস নির্ধারণ করে |

use_global_device_ids | ঐচ্ছিক bool | ReplicaGroup কনফিগে থাকা আইডিগুলো যদি একটি গ্লোবাল আইডিকে প্রতিনিধিত্ব করে, তাহলে true রিটার্ন করে। |

- যখন

operandঅ্যারের একটি টাপল হয়, তখন টাপলটির প্রতিটি উপাদানের উপর অল-রিডিউস প্রয়োগ করা হয়। -

replica_groupsহলো সেইসব রেপ্লিকা গ্রুপের একটি তালিকা, যাদের মধ্যে রিডাকশন প্রক্রিয়াটি সম্পন্ন করা হয় (বর্তমান রেপ্লিকার আইডিReplicaIdব্যবহার করে পাওয়া যায়)।replica_groupsঅবশ্যই হয় খালি থাকতে হবে (সেক্ষেত্রে সমস্ত রেপ্লিকা একটিমাত্র গ্রুপের অন্তর্ভুক্ত হবে), অথবা এতে রেপ্লিকার সংখ্যার সমান সংখ্যক উপাদান থাকতে হবে। উদাহরণস্বরূপ,replica_groups = {0, 2}, {1, 3}রেপ্লিকা0ও2এবং1ও3এর মধ্যে রিডাকশন প্রক্রিয়াটি সম্পন্ন করে। -

channel_idআন্তঃ-মডিউল যোগাযোগের জন্য ব্যবহৃত হয়: শুধুমাত্র একইchannel_idযুক্তall-reduceঅপারেশনগুলোই একে অপরের সাথে যোগাযোগ করতে পারে। -

shape_with_layout: AllReduce-এর লেআউটকে প্রদত্ত লেআউটে বাধ্য করে। আলাদাভাবে কম্পাইল করা একদল AllReduce অপস-এর জন্য একই লেআউট নিশ্চিত করতে এটি ব্যবহৃত হয়। -

use_global_device_idsবিকল্পটি 'true' রিটার্ন করে যদি ReplicaGroup কনফিগারেশনের আইডিগুলো কোনো রেপ্লিকা আইডির পরিবর্তে (replica_id * partition_count + partition_id) আকারের একটি গ্লোবাল আইডিকে নির্দেশ করে। এই অল-রিডিউস প্রক্রিয়াটি যদি ক্রস-পার্টিশন এবং ক্রস-রেপ্লিকা উভয়ই হয়, তবে এটি ডিভাইসগুলোকে আরও নমনীয়ভাবে গ্রুপ করার সুযোগ দেয়।

আউটপুটের আকৃতি ইনপুটের আকৃতির মতোই। উদাহরণস্বরূপ, যদি দুটি রেপ্লিকা থাকে এবং দুটি রেপ্লিকাতে অপারেন্ডের মান যথাক্রমে [1.0, 2.5] এবং [3.0, 5.25] হয়, তাহলে এই অপ এবং যোগফল গণনার ফলে প্রাপ্ত আউটপুট মান উভয় রেপ্লিকাতেই [4.0, 7.75] হবে। যদি ইনপুট একটি টাপল হয়, তাহলে আউটপুটও একটি টাপল হবে।

AllReduce এর ফলাফল গণনা করার জন্য প্রতিটি রেপ্লিকা থেকে একটি করে ইনপুট প্রয়োজন হয়, তাই যদি একটি রেপ্লিকা অন্যটির চেয়ে বেশিবার একটি AllReduce নোড চালায়, তাহলে পূর্ববর্তী রেপ্লিকাটি অনির্দিষ্টকালের জন্য অপেক্ষা করতে থাকবে। যেহেতু রেপ্লিকাগুলো সবই একই প্রোগ্রাম চালাচ্ছে, তাই এমনটা ঘটার সম্ভাবনা খুব বেশি নেই, কিন্তু এটি তখন সম্ভব যখন একটি while লুপের শর্ত infeed থেকে আসা ডেটার উপর নির্ভর করে এবং সেই infeed ডেটার কারণে while লুপটি একটি রেপ্লিকাতে অন্যটির চেয়ে বেশিবার পুনরাবৃত্তি করে।

AllReduce এর API অভ্যন্তরীণভাবে দুটি HLO নির্দেশাবলীতে ( AllReduceStart এবং AllReduceDone ) বিভক্ত।

আরও দেখুন HloInstruction::CreateAllReduceStart ।

AllReduceStart এবং AllReduceDone হলো HLO-এর প্রিমিটিভ। এই অপারেশনগুলো HLO ডাম্পে দেখা যেতে পারে, কিন্তু এগুলো সাধারণ ব্যবহারকারীদের দ্বারা ম্যানুয়ালি তৈরি করার জন্য নয়।

ক্রসরেপ্লিকাসাম

আরও দেখুন XlaBuilder::CrossReplicaSum ।

যোগফল গণনার মাধ্যমে AllReduce সম্পাদন করে।

CrossReplicaSum(operand, replica_groups)

| যুক্তি | প্রকার | শব্দার্থবিদ্যা |

|---|---|---|

operand | XlaOp | রেপ্লিকা জুড়ে রিডিউস করার জন্য অ্যারে অথবা অ্যারের একটি অ-খালি টাপল। |

replica_groups | int64 এর ভেক্টরসমূহের ভেক্টর | যে গোষ্ঠীগুলির মধ্যে হ্রাসগুলি সম্পাদন করা হয় |

রেপ্লিকাগুলোর প্রতিটি উপগোষ্ঠীর মধ্যে অপারেন্ড মানগুলোর যোগফল ফেরত দেয়। সমস্ত রেপ্লিকা যোগফলের জন্য একটি ইনপুট সরবরাহ করে এবং প্রতিটি উপগোষ্ঠীর জন্য প্রাপ্ত যোগফলটিও সমস্ত রেপ্লিকা গ্রহণ করে।

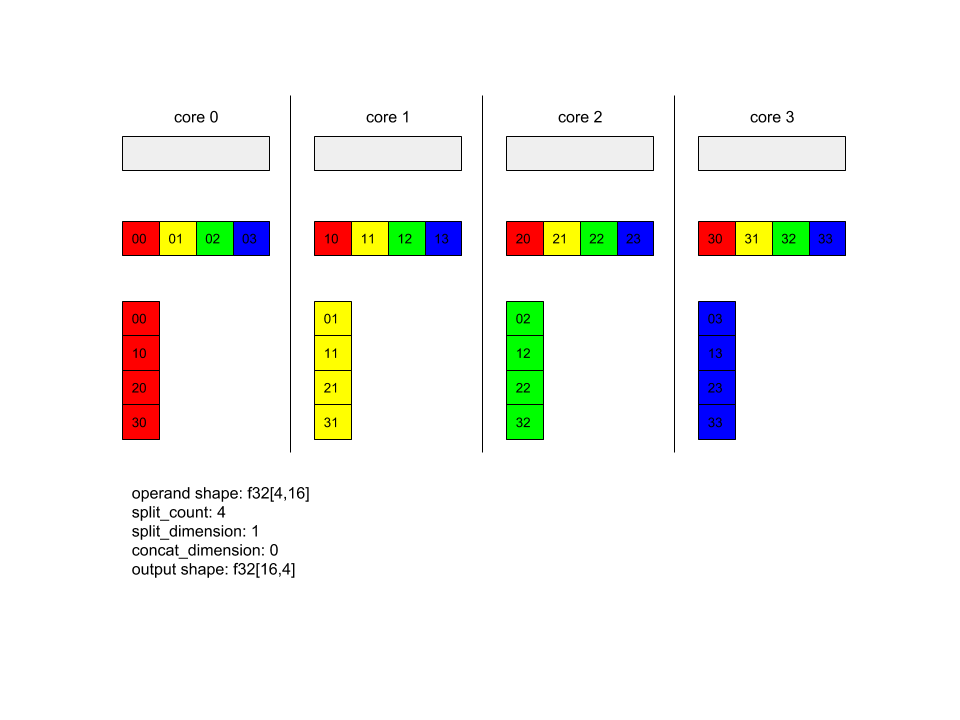

অলটুঅল

আরও দেখুন XlaBuilder::AllToAll ।

AllToAll হলো একটি সম্মিলিত অপারেশন যা সমস্ত কোর থেকে সমস্ত কোরে ডেটা পাঠায়। এর দুটি পর্যায় রয়েছে:

- স্ক্যাটার পর্যায়। প্রতিটি কোরে, অপারেন্ডটিকে

split_dimensionsবরাবরsplit_countসংখ্যক ব্লকে বিভক্ত করা হয় এবং ব্লকগুলি সমস্ত কোরে ছড়িয়ে দেওয়া হয়, যেমন, i-তম ব্লকটি i-তম কোরে পাঠানো হয়। - সংগ্রহ পর্ব। প্রতিটি কোর

concat_dimensionবরাবর প্রাপ্ত ব্লকগুলোকে সংযুক্ত করে।

অংশগ্রহণকারী কোরগুলো নিম্নোক্ত উপায়ে কনফিগার করা যেতে পারে:

-

replica_groups: প্রতিটি ReplicaGroup-এ গণনায় অংশগ্রহণকারী রেপ্লিকা আইডিগুলোর একটি তালিকা থাকে (বর্তমান রেপ্লিকার আইডিReplicaIdব্যবহার করে পাওয়া যায়)। AllToAll নির্দিষ্ট ক্রমে সাবগ্রুপগুলোর মধ্যে প্রয়োগ করা হবে। উদাহরণস্বরূপ,replica_groups = { {1,2,3}, {4,5,0} }এর অর্থ হলো{1, 2, 3}রেপ্লিকাগুলোর মধ্যে একটি AllToAll প্রয়োগ করা হবে এবং গ্যাদার পর্যায়ে প্রাপ্ত ব্লকগুলো 1, 2, 3-এর একই ক্রমে সংযুক্ত করা হবে। এরপর, 4, 5, 0 রেপ্লিকাগুলোর মধ্যে আরেকটি AllToAll প্রয়োগ করা হবে এবং সংযুক্ত করার ক্রমটিও হবে 4, 5, 0। যদিreplica_groupsখালি থাকে, তবে সমস্ত রেপ্লিকা তাদের উপস্থিতির সংযুক্তি ক্রম অনুসারে একটি গ্রুপের অন্তর্ভুক্ত হবে।

পূর্বশর্তসমূহ:

-

split_dimensionএর অপারেন্ডের ডাইমেনশন সাইজsplit_countদ্বারা বিভাজ্য। - অপারেন্ডটির আকৃতি টাপল নয়।

AllToAll(operand, split_dimension, concat_dimension, split_count, replica_groups, layout, channel_id)

| যুক্তি | প্রকার | শব্দার্থবিদ্যা |

|---|---|---|

operand | XlaOp | n মাত্রিক ইনপুট অ্যারে |

split_dimension | int64 | [0,n) ব্যবধির মধ্যে একটি মান যা সেই মাত্রাটিকে নির্দেশ করে যে বরাবর অপারেন্ডটি বিভক্ত করা হয়। |

concat_dimension | int64 | [0,n) ব্যবধির মধ্যে একটি মান যা সেই মাত্রাটিকে নির্দেশ করে, যে বরাবর বিভক্ত ব্লকগুলিকে সংযুক্ত করা হয়। |

split_count | int64 | এই অপারেশনে অংশগ্রহণকারী কোরের সংখ্যা। যদি replica_groups খালি থাকে, তবে এটি রেপ্লিকার সংখ্যা হবে; অন্যথায়, এটি প্রতিটি গ্রুপের রেপ্লিকার সংখ্যার সমান হবে। |

replica_groups | ReplicaGroup ভেক্টর | প্রতিটি গ্রুপে রেপ্লিকা আইডিগুলোর একটি তালিকা থাকে। |

layout | ঐচ্ছিক Layout | ব্যবহারকারী-নির্দিষ্ট মেমরি লেআউট |

channel_id | ঐচ্ছিক ChannelHandle | প্রতিটি প্রেরণ/গ্রহণ জোড়ার জন্য অনন্য শনাক্তকারী |

শেপ ও লেআউট সম্পর্কে আরও তথ্যের জন্য xla::shapes দেখুন।

StableHLO তথ্যের জন্য StableHLO - all_to_all দেখুন।

AllToAll - উদাহরণ ১।

XlaBuilder b("alltoall");

auto x = Parameter(&b, 0, ShapeUtil::MakeShape(F32, {4, 16}), "x");

AllToAll(

x,

/*split_dimension=*/ 1,

/*concat_dimension=*/ 0,

/*split_count=*/ 4);

উপরের উদাহরণে, Alltoall-এ ৪টি কোর অংশগ্রহণ করছে। প্রতিটি কোরে, অপারেন্ডটি ডাইমেনশন ১ বরাবর ৪টি অংশে বিভক্ত হয়, ফলে প্রতিটি অংশের আকৃতি হয় f32[4,4]। এই ৪টি অংশ সমস্ত কোরে ছড়িয়ে দেওয়া হয়। এরপর প্রতিটি কোর, কোর ০-৪ এর ক্রমানুসারে, ডাইমেনশন ০ বরাবর প্রাপ্ত অংশগুলোকে সংযুক্ত করে। ফলে প্রতিটি কোরের আউটপুটের আকৃতি হয় f32[16,4]।

AllToAll - উদাহরণ ২ - StableHLO

উপরের উদাহরণে, AllToAll-এ ২টি রেপ্লিকা অংশগ্রহণ করছে। প্রতিটি রেপ্লিকাতে, অপারেন্ডটির আকৃতি f32[2,4]। অপারেন্ডটিকে ডাইমেনশন ১ বরাবর ২টি অংশে বিভক্ত করা হয়, ফলে প্রতিটি অংশের আকৃতি হয় f32[2,2]। এরপর রেপ্লিকা গ্রুপে তাদের অবস্থান অনুযায়ী রেপ্লিকাগুলোর মধ্যে অংশ দুটি বিনিময় করা হয়। প্রতিটি রেপ্লিকা উভয় অপারেন্ড থেকে তার সংশ্লিষ্ট অংশ সংগ্রহ করে এবং ডাইমেনশন ০ বরাবর সেগুলোকে সংযুক্ত করে। ফলে, প্রতিটি রেপ্লিকার আউটপুটের আকৃতি হয় f32[4,2]।

RaggedAllToAll

আরও দেখুন XlaBuilder::RaggedAllToAll ।

RaggedAllToAll একটি সম্মিলিত অল-টু-অল অপারেশন সম্পাদন করে, যেখানে ইনপুট এবং আউটপুট হলো র্যাগড টেনসর।

RaggedAllToAll(input, input_offsets, send_sizes, output, output_offsets, recv_sizes, replica_groups, channel_id)

| যুক্তি | প্রকার | শব্দার্থবিদ্যা |

|---|---|---|

input | XlaOp | T টাইপের N অ্যারে |

input_offsets | XlaOp | T টাইপের N অ্যারে |

send_sizes | XlaOp | T টাইপের N অ্যারে |

output | XlaOp | T টাইপের N অ্যারে |

output_offsets | XlaOp | T টাইপের N অ্যারে |

recv_sizes | XlaOp | T টাইপের N অ্যারে |

replica_groups | ReplicaGroup ভেক্টর | প্রতিটি গ্রুপে রেপ্লিকা আইডিগুলোর একটি তালিকা থাকে। |

channel_id | ঐচ্ছিক ChannelHandle | প্রতিটি প্রেরণ/গ্রহণ জোড়ার জন্য অনন্য শনাক্তকারী |

র্যাগড টেনসর তিনটি টেনসরের একটি সেট দ্বারা সংজ্ঞায়িত করা হয়:

-

data:dataটেনসরটি এর সর্ববহিঃস্থ মাত্রা বরাবর "অমসৃণ" হয়, যে বরাবর প্রতিটি সূচিত উপাদানের আকার পরিবর্তনশীল। -

offsets':offsetsটেনসরটিdataটেনসরের সর্ববহিঃস্থ ডাইমেনশনকে সূচিত করে এবংdataটেনসরের প্রতিটি র্যাগড এলিমেন্টের প্রারম্ভিক অফসেটকে উপস্থাপন করে। -

sizes:sizesটেনসরটিdataটেনসরের প্রতিটি র্যাগড এলিমেন্টের আকারকে উপস্থাপন করে, যেখানে আকারটি সাব-এলিমেন্টের এককে নির্দিষ্ট করা হয়। একটি সাব-এলিমেন্টকে 'data' টেনসর শেপের সাফিক্স হিসাবে সংজ্ঞায়িত করা হয়, যা সবচেয়ে বাইরের “র্যাগড” ডাইমেনশনটি অপসারণ করে পাওয়া যায়। -

offsetsএবংsizesটেনসরগুলোর আকার অবশ্যই একই হতে হবে।

একটি র্যাগড টেনসরের উদাহরণ:

data: [8,3] =

{ {a,b,c},{d,e,f},{g,h,i},{j,k,l},{m,n,o},{p,q,r},{s,t,u},{v,w,x} }

offsets: [3] = {0, 1, 4}

sizes: [3] = {1, 3, 4}

// Index 'data' at 'offsets'[0], 'sizes'[0]' // {a,b,c}

// Index 'data' at 'offsets'[1], 'sizes'[1]' // {d,e,f},{g,h,i},{j,k,l}

// Index 'data' at 'offsets'[2], 'sizes'[2]' // {m,n,o},{p,q,r},{s,t,u},{v,w,x}

output_offsets এমনভাবে শার্ড করতে হবে যাতে প্রতিটি রেপ্লিকার টার্গেট রেপ্লিকার আউটপুট দৃষ্টিকোণ থেকে অফসেট থাকে।

i-তম আউটপুট অফসেটের জন্য, বর্তমান রেপ্লিকা i-তম রেপ্লিকাতে input[input_offsets[i]:input_offsets[i]+send_sizes[i]] আপডেট পাঠাবে যা i তম রেপ্লিকার output output_i[output_offsets[i]:output_offsets[i]+send_sizes[i]] i তে লেখা হবে।

উদাহরণস্বরূপ, যদি আমাদের ২টি রেপ্লিকা থাকে:

replica 0:

input: [1, 2, 2]

output:[0, 0, 0, 0]

input_offsets: [0, 1]

send_sizes: [1, 2]

output_offsets: [0, 0]

recv_sizes: [1, 1]

replica 1:

input: [3, 4, 0]

output: [0, 0, 0, 0]

input_offsets: [0, 1]

send_sizes: [1, 1]

output_offsets: [1, 2]

recv_sizes: [2, 1]

// replica 0's result will be: [1, 3, 0, 0]

// replica 1's result will be: [2, 2, 4, 0]

র্যাগড অল-টু-অল HLO-এর নিম্নলিখিত আর্গুমেন্টগুলো রয়েছে:

-

input: অমসৃণ ইনপুট ডেটা টেনসর। -

output: অমসৃণ আউটপুট ডেটা টেনসর। -

input_offsets: র্যাগড ইনপুট অফসেট টেনসর। -

send_sizes: র্যাগড প্রেরণ আকারের টেনসর। -

output_offsets: টার্গেট রেপ্লিকা আউটপুটে থাকা র্যাগড অফসেটগুলোর অ্যারে। -

recv_sizes: র্যাগড রিসিভ সাইজ টেনসর।

*_offsets এবং *_sizes টেনসরগুলোর আকৃতি অবশ্যই একই হতে হবে।

*_offsets এবং *_sizes টেনসরগুলোর জন্য দুটি আকৃতি সমর্থিত:

-

[num_devices]যেখানে ragged-all-to-all রেপ্লিকা গ্রুপের প্রতিটি রিমোট ডিভাইসে সর্বাধিক একটি আপডেট পাঠাতে পারে। উদাহরণস্বরূপ:

for (remote_device_id : replica_group) {

SEND input[input_offsets[remote_device_id]],

output[output_offsets[remote_device_id]],

send_sizes[remote_device_id] }

[num_devices, num_updates]যেখানে ragged-all-to-all রেপ্লিকা গ্রুপের প্রতিটি রিমোট ডিভাইসের জন্য একই রিমোট ডিভাইসে (প্রতিটি ভিন্ন ভিন্ন অফসেটে) সর্বোচ্চnum_updatesসংখ্যক আপডেট পাঠাতে পারে।

উদাহরণস্বরূপ:

for (remote_device_id : replica_group) {

for (update_idx : num_updates) {

SEND input[input_offsets[remote_device_id][update_idx]],

output[output_offsets[remote_device_id][update_idx]]],

send_sizes[remote_device_id][update_idx] } }

এবং

আরও দেখুন XlaBuilder::And ।

দুটি টেনসর lhs এবং rhs এর উপাদানভিত্তিক AND অপারেশন করে।

And(lhs, rhs)

| যুক্তি | প্রকার | শব্দার্থবিদ্যা |

|---|---|---|

| বাম পাশ | XlaOp | বাম-পার্শ্বের অপারেন্ড: T টাইপের অ্যারে |

| আরএইচএস | XlaOp | বাম-পার্শ্বের অপারেন্ড: T টাইপের অ্যারে |

আর্গুমেন্টগুলোর শেপ অবশ্যই সদৃশ বা সামঞ্জস্যপূর্ণ হতে হবে। শেপ সামঞ্জস্যপূর্ণ বলতে কী বোঝায়, তা জানতে ব্রডকাস্টিং ডকুমেন্টেশন দেখুন। একটি অপারেশনের ফলাফলের শেপটি হলো দুটি ইনপুট অ্যারের ব্রডকাস্টিংয়ের ফল। এই ভ্যারিয়েন্টে, ভিন্ন র্যাঙ্কের অ্যারের মধ্যে অপারেশন সমর্থিত নয় , যদি না অপারেন্ডগুলোর মধ্যে একটি স্কেলার হয়।

And-এর জন্য বিভিন্ন-মাত্রিক সম্প্রচার সমর্থন সহ একটি বিকল্প সংস্করণ বিদ্যমান:

And(lhs,rhs, broadcast_dimensions)

| যুক্তি | প্রকার | শব্দার্থবিদ্যা |

|---|---|---|

| বাম পাশ | XlaOp | বাম-পার্শ্বের অপারেন্ড: T টাইপের অ্যারে |

| আরএইচএস | XlaOp | বাম-পার্শ্বের অপারেন্ড: T টাইপের অ্যারে |

| সম্প্রচার_মাত্রা | অ্যারেস্লাইস | টার্গেট শেপের কোন ডাইমেনশনের সাথে অপারেন্ড শেপের প্রতিটি ডাইমেনশন সঙ্গতিপূর্ণ |

অপারেশনটির এই রূপটি ভিন্ন র্যাঙ্কের অ্যারেগুলোর মধ্যে গাণিতিক ক্রিয়াকলাপের জন্য ব্যবহার করা উচিত (যেমন একটি ম্যাট্রিক্সের সাথে একটি ভেক্টর যোগ করা)।

অতিরিক্ত broadcast_dimensions অপারেন্ডটি হলো পূর্ণসংখ্যার একটি স্লাইস, যা অপারেন্ডগুলো ব্রডকাস্ট করার জন্য ব্যবহৃত ডাইমেনশনগুলো নির্দিষ্ট করে। এর কার্যপ্রণালী ব্রডকাস্টিং পৃষ্ঠায় বিস্তারিতভাবে বর্ণনা করা হয়েছে।

StableHLO তথ্যের জন্য StableHLO - এবং . দেখুন।

অ্যাসিঙ্ক

আরও দেখুন HloInstruction::CreateAsyncStart , HloInstruction::CreateAsyncUpdate , HloInstruction::CreateAsyncDone ।

AsyncDone , AsyncStart , এবং AsyncUpdate হলো অ্যাসিঙ্ক্রোনাস অপারেশনের জন্য ব্যবহৃত অভ্যন্তরীণ HLO নির্দেশাবলী এবং এগুলো HLO-তে প্রিমিটিভ হিসেবে কাজ করে। এই অপারেশনগুলো HLO ডাম্পে দেখা যেতে পারে, কিন্তু এগুলো ব্যবহারকারীদের দ্বারা ম্যানুয়ালি তৈরি করার জন্য নয়।

আতান২

আরও দেখুন XlaBuilder::Atan2 ।

lhs এবং rhs উপর উপাদানভিত্তিক atan2 অপারেশন সম্পাদন করে।

Atan2(lhs, rhs)

| যুক্তি | প্রকার | শব্দার্থবিদ্যা |

|---|---|---|

| বাম পাশ | XlaOp | বাম-পার্শ্বের অপারেন্ড: T টাইপের অ্যারে |

| আরএইচএস | XlaOp | বাম-পার্শ্বের অপারেন্ড: T টাইপের অ্যারে |

আর্গুমেন্টগুলোর শেপ অবশ্যই সদৃশ বা সামঞ্জস্যপূর্ণ হতে হবে। শেপ সামঞ্জস্যপূর্ণ বলতে কী বোঝায়, তা জানতে ব্রডকাস্টিং ডকুমেন্টেশন দেখুন। একটি অপারেশনের ফলাফলের শেপটি হলো দুটি ইনপুট অ্যারের ব্রডকাস্টিংয়ের ফল। এই ভ্যারিয়েন্টে, ভিন্ন র্যাঙ্কের অ্যারের মধ্যে অপারেশন সমর্থিত নয় , যদি না অপারেন্ডগুলোর মধ্যে একটি স্কেলার হয়।

Atan2-এর জন্য বিভিন্ন-মাত্রিক সম্প্রচার সমর্থন সহ একটি বিকল্প সংস্করণ বিদ্যমান:

Atan2(lhs,rhs, broadcast_dimensions)

| যুক্তি | প্রকার | শব্দার্থবিদ্যা |

|---|---|---|

| বাম পাশ | XlaOp | বাম-পার্শ্বের অপারেন্ড: T টাইপের অ্যারে |

| আরএইচএস | XlaOp | বাম-পার্শ্বের অপারেন্ড: T টাইপের অ্যারে |

| সম্প্রচার_মাত্রা | অ্যারেস্লাইস | টার্গেট শেপের কোন ডাইমেনশনের সাথে অপারেন্ড শেপের প্রতিটি ডাইমেনশন সঙ্গতিপূর্ণ |

অপারেশনটির এই রূপটি ভিন্ন র্যাঙ্কের অ্যারেগুলোর মধ্যে গাণিতিক ক্রিয়াকলাপের জন্য ব্যবহার করা উচিত (যেমন একটি ম্যাট্রিক্সের সাথে একটি ভেক্টর যোগ করা)।

অতিরিক্ত broadcast_dimensions অপারেন্ডটি হলো পূর্ণসংখ্যার একটি স্লাইস, যা অপারেন্ডগুলো ব্রডকাস্ট করার জন্য ব্যবহৃত ডাইমেনশনগুলো নির্দিষ্ট করে। এর কার্যপ্রণালী ব্রডকাস্টিং পৃষ্ঠায় বিস্তারিতভাবে বর্ণনা করা হয়েছে।

StableHLO তথ্যের জন্য StableHLO - atan2 দেখুন।

ব্যাচনর্মগ্র্যাড

অ্যালগরিদমটির বিস্তারিত বিবরণের জন্য XlaBuilder::BatchNormGrad এবং মূল ব্যাচ নর্মালাইজেশন পেপারটিও দেখুন।

ব্যাচ নর্মের গ্রেডিয়েন্ট গণনা করে।

BatchNormGrad(operand, scale, batch_mean, batch_var, grad_output, epsilon, feature_index)

| যুক্তি | প্রকার | শব্দার্থবিদ্যা |

|---|---|---|

operand | XlaOp | স্বাভাবিকীকরণ করার জন্য n মাত্রিক অ্যারে (x) |

scale | XlaOp | ১ মাত্রিক অ্যারে (\(\gamma\)) |

batch_mean | XlaOp | ১ মাত্রিক অ্যারে (\(\mu\)) |

batch_var | XlaOp | ১ মাত্রিক অ্যারে (\(\sigma^2\)) |

grad_output | XlaOp | BatchNormTraining -এ উত্তীর্ণ গ্রেডিয়েন্ট (\(\nabla y\)) |

epsilon | float | এপসিলন মান (\(\epsilon\)) |

feature_index | int64 | operand ফিচার ডাইমেনশনের সূচক |

ফিচার ডাইমেনশনের প্রতিটি ফিচারের জন্য ( feature_index হলো operand থাকা ফিচার ডাইমেনশনের ইনডেক্স), অপারেশনটি operand , offset এবং scale সাপেক্ষে অন্য সমস্ত ডাইমেনশন জুড়ে গ্রেডিয়েন্ট গণনা করে। feature_index অবশ্যই operand থাকা ফিচার ডাইমেনশনের জন্য একটি বৈধ ইনডেক্স হতে হবে।

তিনটি গ্রেডিয়েন্ট নিম্নলিখিত সূত্র দ্বারা সংজ্ঞায়িত করা হয় ( operand হিসাবে একটি ৪-মাত্রিক অ্যারে এবং ফিচার ডাইমেনশন ইনডেক্স l , ব্যাচ সাইজ m এবং স্পেশিয়াল সাইজ w ও h ধরে নিয়ে):

\[ \begin{split} c_l&= \frac{1}{mwh}\sum_{i=1}^m\sum_{j=1}^w\sum_{k=1}^h \left( \nabla y_{ijkl} \frac{x_{ijkl} - \mu_l}{\sigma^2_l+\epsilon} \right) \\\\ d_l&= \frac{1}{mwh}\sum_{i=1}^m\sum_{j=1}^w\sum_{k=1}^h \nabla y_{ijkl} \\\\ \nabla x_{ijkl} &= \frac{\gamma_{l} }{\sqrt{\sigma^2_{l}+\epsilon} } \left( \nabla y_{ijkl} - d_l - c_l (x_{ijkl} - \mu_{l}) \right) \\\\ \nabla \gamma_l &= \sum_{i=1}^m\sum_{j=1}^w\sum_{k=1}^h \left( \nabla y_{ijkl} \frac{x_{ijkl} - \mu_l}{\sqrt{\sigma^2_{l}+\epsilon} } \right) \\\\\ \nabla \beta_l &= \sum_{i=1}^m\sum_{j=1}^w\sum_{k=1}^h \nabla y_{ijkl} \end{split} \]

ইনপুট batch_mean এবং batch_var ব্যাচ এবং স্থানিক মাত্রা জুড়ে মোমেন্টস মান উপস্থাপন করে।

আউটপুট টাইপটি তিনটি হ্যান্ডেলের একটি টাপল:

| আউটপুট | প্রকার | শব্দার্থবিদ্যা |

|---|---|---|

grad_operand | XlaOp | ইনপুট operand সাপেক্ষে গ্রেডিয়েন্ট (\(\nabla x\)) |

grad_scale | XlaOp | ইনপুট scale সাপেক্ষে গ্রেডিয়েন্ট (\(\nabla\gamma\)) |

grad_offset | XlaOp | ইনপুট offset সাপেক্ষে গ্রেডিয়েন্ট (\(\nabla\beta\)) |

StableHLO তথ্যের জন্য StableHLO - batch_norm_grad দেখুন।

ব্যাচ নর্ম ইনফারেন্স

অ্যালগরিদমটির বিস্তারিত বিবরণের জন্য XlaBuilder::BatchNormInference এবং মূল ব্যাচ নর্মালাইজেশন পেপারটিও দেখুন।

ব্যাচ এবং স্থানিক মাত্রা জুড়ে একটি অ্যারে স্বাভাবিক করে।

BatchNormInference(operand, scale, offset, mean, variance, epsilon, feature_index)

| যুক্তি | প্রকার | শব্দার্থবিদ্যা |

|---|---|---|

operand | XlaOp | n মাত্রিক অ্যারে স্বাভাবিকীকরণ করতে হবে |

scale | XlaOp | ১ মাত্রিক অ্যারে |

offset | XlaOp | ১ মাত্রিক অ্যারে |

mean | XlaOp | ১ মাত্রিক অ্যারে |

variance | XlaOp | ১ মাত্রিক অ্যারে |

epsilon | float | এপসিলন মান |

feature_index | int64 | operand ফিচার ডাইমেনশনের সূচক |

ফিচার ডাইমেনশনের প্রতিটি ফিচারের জন্য ( feature_index হলো operand থাকা ফিচার ডাইমেনশনের ইনডেক্স), অপারেশনটি অন্য সব ডাইমেনশন জুড়ে গড় এবং ভেদাঙ্ক গণনা করে এবং সেই গড় ও ভেদাঙ্ক ব্যবহার করে operand থাকা প্রতিটি উপাদানকে নর্মালাইজ করে। feature_index অবশ্যই operand থাকা ফিচার ডাইমেনশনের জন্য একটি বৈধ ইনডেক্স হতে হবে।

BatchNormInference হলো প্রতিটি ব্যাচের জন্য mean এবং variance গণনা না করে BatchNormTraining কল করার সমতুল্য। এর পরিবর্তে এটি আনুমানিক মান হিসেবে ইনপুট mean এবং variance ব্যবহার করে। এই অপারেশনের উদ্দেশ্য হলো ইনফারেন্সের বিলম্ব কমানো, তাই এর নাম BatchNormInference ।

আউটপুটটি হলো একটি n-মাত্রিক, স্বাভাবিকীকৃত অ্যারে, যার আকৃতি ইনপুট operand আকৃতির সমান।

StableHLO তথ্যের জন্য StableHLO - batch_norm_inference দেখুন।

ব্যাচ নর্ম ট্রেনিং

অ্যালগরিদমটির বিস্তারিত বিবরণের জন্য XlaBuilder::BatchNormTraining এবং the original batch normalization paper দেখুন।

ব্যাচ এবং স্থানিক মাত্রা জুড়ে একটি অ্যারে স্বাভাবিক করে।

BatchNormTraining(operand, scale, offset, epsilon, feature_index)

| যুক্তি | প্রকার | শব্দার্থবিদ্যা |

|---|---|---|

operand | XlaOp | স্বাভাবিকীকরণ করার জন্য n মাত্রিক অ্যারে (x) |

scale | XlaOp | ১ মাত্রিক অ্যারে (\(\gamma\)) |

offset | XlaOp | ১ মাত্রিক অ্যারে (\(\beta\)) |

epsilon | float | এপসিলন মান (\(\epsilon\)) |

feature_index | int64 | operand ফিচার ডাইমেনশনের সূচক |

ফিচার ডাইমেনশনের প্রতিটি ফিচারের জন্য ( feature_index হলো operand থাকা ফিচার ডাইমেনশনের ইনডেক্স), অপারেশনটি অন্য সব ডাইমেনশন জুড়ে গড় এবং ভেদাঙ্ক গণনা করে এবং সেই গড় ও ভেদাঙ্ক ব্যবহার করে operand থাকা প্রতিটি উপাদানকে নর্মালাইজ করে। feature_index অবশ্যই operand থাকা ফিচার ডাইমেনশনের জন্য একটি বৈধ ইনডেক্স হতে হবে।

operand প্রতিটি ব্যাচের জন্য অ্যালগরিদমটি নিম্নরূপভাবে কাজ করে। \(x\) যেটিতে m সংখ্যক উপাদান রয়েছে এবং যেখানে w ও h হলো স্থানিক মাত্রার আকার (ধরে নেওয়া হচ্ছে operand একটি ৪-মাত্রিক অ্যারে):

ব্যাচ গড় গণনা করে \(\mu_l\) ফিচার ডাইমেনশনের প্রতিটি ফিচার

lএর জন্য:\(\mu_l=\frac{1}{mwh}\sum_{i=1}^m\sum_{j=1}^w\sum_{k=1}^h x_{ijkl}\)ব্যাচ বৈচিত্র্য গণনা করে \(\sigma^2_l\)$\sigma^2 l=\frac{1}{mwh}\sum {i=1}^m\sum {j=1}^w\sum {k=1}^h (x_{ijkl} - \mu_l)^2$

স্বাভাবিক করে, পরিমাপ করে এবং স্থানান্তরিত করে:\(y_{ijkl}=\frac{\gamma_l(x_{ijkl}-\mu_l)}{\sqrt[2]{\sigma^2_l+\epsilon} }+\beta_l\)

শূন্য দ্বারা ভাগের ত্রুটি এড়ানোর জন্য এপসিলন মানটি যোগ করা হয়, যা সাধারণত একটি ক্ষুদ্র সংখ্যা।

আউটপুট টাইপটি তিনটি XlaOp এর একটি টাপল:

| আউটপুট | প্রকার | শব্দার্থবিদ্যা |

|---|---|---|

output | XlaOp | ইনপুট operand (y) এর সমান আকৃতির n মাত্রিক অ্যারে |

batch_mean | XlaOp | ১ মাত্রিক অ্যারে (\(\mu\)) |

batch_var | XlaOp | ১ মাত্রিক অ্যারে (\(\sigma^2\)) |

batch_mean এবং batch_var হলো উপরের সূত্রগুলো ব্যবহার করে ব্যাচ এবং স্থানিক মাত্রা জুড়ে গণনা করা মোমেন্ট।

StableHLO তথ্যের জন্য StableHLO - batch_norm_training দেখুন।

বিটকাস্ট

আরও দেখুন HloInstruction::CreateBitcast ।

HLO ডাম্পে Bitcast দেখা যেতে পারে, কিন্তু সাধারণ ব্যবহারকারীদের দ্বারা এগুলো ম্যানুয়ালি তৈরি করার উদ্দেশ্যে তৈরি করা হয়নি।

বিটকাস্টকনভার্টটাইপ

আরও দেখুন XlaBuilder::BitcastConvertType ।

TensorFlow-এর tf.bitcast মতোই, এটি একটি ডেটা শেপ থেকে টার্গেট শেপে এলিমেন্ট-ভিত্তিক বিটকাস্ট অপারেশন সম্পাদন করে। ইনপুট এবং আউটপুট সাইজ অবশ্যই মিলতে হবে: যেমন, বিটকাস্ট রুটিনের মাধ্যমে s32 এলিমেন্টগুলো f32 এলিমেন্টে পরিণত হয়, এবং একটি s32 এলিমেন্ট চারটি s8 এলিমেন্টে রূপান্তরিত হবে। বিটকাস্ট একটি লো-লেভেল কাস্ট হিসাবে প্রয়োগ করা হয়, তাই ভিন্ন ফ্লোটিং-পয়েন্ট রিপ্রেজেন্টেশনযুক্ত মেশিনগুলো ভিন্ন ভিন্ন ফলাফল দেবে।

BitcastConvertType(operand, new_element_type)

| যুক্তি | প্রকার | শব্দার্থবিদ্যা |

|---|---|---|

operand | XlaOp | D মাত্রা সহ T টাইপের অ্যারে |

new_element_type | PrimitiveType | টাইপ ইউ |

অপারেন্ড এবং টার্গেট শেপের ডাইমেনশন অবশ্যই মিলতে হবে, তবে শেষ ডাইমেনশনটি ছাড়া, যা রূপান্তরের আগে ও পরের প্রিমিটিভ সাইজের অনুপাতে পরিবর্তিত হবে।

উৎস এবং গন্তব্য উপাদানের প্রকার অবশ্যই টাপল হবে না।

StableHLO তথ্যের জন্য StableHLO - bitcast_convert দেখুন।

ভিন্ন প্রস্থের প্রিমিটিভ টাইপে বিটকাস্ট-রূপান্তর

BitcastConvert HLO ইন্সট্রাকশনটি এমন একটি ক্ষেত্র সমর্থন করে যেখানে আউটপুট এলিমেন্ট টাইপ T' এর সাইজ ইনপুট এলিমেন্ট T এর সাইজের সমান হয় না। যেহেতু সম্পূর্ণ অপারেশনটি ধারণাগতভাবে একটি বিটকাস্ট এবং এটি অন্তর্নিহিত বাইটগুলোকে পরিবর্তন করে না, তাই আউটপুট এলিমেন্টের আকৃতি পরিবর্তন করতে হয়। B = sizeof(T), B' = sizeof(T') -এর ক্ষেত্রে দুটি সম্ভাব্য ক্ষেত্র রয়েছে।

প্রথমত, যখন B > B' হয়, তখন আউটপুট আকৃতিটি B/B' আকারের একটি নতুন ক্ষুদ্রতম মাত্রা পায়। উদাহরণস্বরূপ:

f16[10,2]{1,0} %output = f16[10,2]{1,0} bitcast-convert(f32[10]{0} %input)

কার্যকরী স্কেলারের ক্ষেত্রেও নিয়মটি একই থাকে:

f16[2]{0} %output = f16[2]{0} bitcast-convert(f32[] %input)

বিকল্পভাবে, B' > B এর ক্ষেত্রে নির্দেশটি অনুযায়ী ইনপুট শেপের শেষ লজিক্যাল ডাইমেনশনকে B'/B এর সমান হতে হয়, এবং রূপান্তরের সময় এই ডাইমেনশনটি বাদ দেওয়া হয়:

f32[10]{0} %output = f32[10]{0} bitcast-convert(f16[10,2]{1,0} %input)

উল্লেখ্য যে, ভিন্ন ভিন্ন বিটউইডথের মধ্যে রূপান্তরগুলো এলিমেন্টওয়াইজ হয় না।

সম্প্রচার

আরও দেখুন XlaBuilder::Broadcast ।

অ্যারের ডেটা নকল করার মাধ্যমে এতে ডাইমেনশন যোগ করে।

Broadcast(operand, broadcast_sizes)

| যুক্তি | প্রকার | শব্দার্থবিদ্যা |

|---|---|---|

operand | XlaOp | ডুপ্লিকেট করার জন্য অ্যারে |

broadcast_sizes | ArraySlice<int64> | নতুন মাত্রাগুলির মাপ |

নতুন ডাইমেনশনগুলো বাম দিকে যুক্ত করা হয়, অর্থাৎ যদি broadcast_sizes মান {a0, ..., aN} হয় এবং অপারেন্ড shape-এর ডাইমেনশন {b0, ..., bM} হয়, তাহলে আউটপুটের shape-এর ডাইমেনশন হবে {a0, ..., aN, b0, ..., bM} ।

নতুন মাত্রাগুলি অপারেন্ডের অনুলিপিগুলিকে সূচিত করে, অর্থাৎ

output[i0, ..., iN, j0, ..., jM] = operand[j0, ..., jM]

উদাহরণস্বরূপ, যদি operand 2.0f মানের একটি স্কেলার f32 হয় এবং broadcast_sizes হয় {2, 3} , তাহলে ফলাফলটি f32[2, 3] আকারের একটি অ্যারে হবে এবং ফলাফলের সমস্ত মান 2.0f হবে।

StableHLO তথ্যের জন্য StableHLO - broadcast দেখুন।

ব্রডকাস্টইনডিম

আরও দেখুন XlaBuilder::BroadcastInDim ।

অ্যারের ডেটা প্রতিলিপি করার মাধ্যমে এর আকার এবং ডাইমেনশনের সংখ্যা বৃদ্ধি করে।

BroadcastInDim(operand, out_dim_size, broadcast_dimensions)

| যুক্তি | প্রকার | শব্দার্থবিদ্যা |

|---|---|---|

operand | XlaOp | ডুপ্লিকেট করার জন্য অ্যারে |

out_dim_size | ArraySlice<int64> | লক্ষ্য আকৃতির মাত্রাগুলির মাপ |

broadcast_dimensions | ArraySlice<int64> | টার্গেট শেপের কোন ডাইমেনশনের সাথে অপারেন্ড শেপের প্রতিটি ডাইমেনশন সঙ্গতিপূর্ণ |

ব্রডকাস্টের মতোই, তবে এর মাধ্যমে যেকোনো জায়গায় ডাইমেনশন যোগ করা যায় এবং বিদ্যমান ডাইমেনশনগুলোকে সাইজ ১ দিয়ে প্রসারিত করা যায়।

operand out_dim_size দ্বারা বর্ণিত শেপে ব্রডকাস্ট করা হয়। broadcast_dimensions operand ডাইমেনশনগুলোকে টার্গেট শেপের ডাইমেনশনের সাথে ম্যাপ করে, অর্থাৎ অপারেন্ডের i-তম ডাইমেনশনটি আউটপুট শেপের broadcast_dimension[i]-তম ডাইমেনশনের সাথে ম্যাপ করা হয়। operand ডাইমেনশনগুলোর সাইজ অবশ্যই ১ হতে হবে অথবা আউটপুট শেপের যে ডাইমেনশনের সাথে সেগুলোকে ম্যাপ করা হয়, তার সমান সাইজের হতে হবে। অবশিষ্ট ডাইমেনশনগুলো ১ সাইজের ডাইমেনশন দিয়ে পূরণ করা হয়। এরপর ডিজেনারেট-ডাইমেনশন ব্রডকাস্টিং এই ডিজেনারেট ডাইমেনশনগুলো বরাবর ব্রডকাস্ট করে আউটপুট শেপে পৌঁছায়। এর অর্থ বিস্তারিতভাবে ব্রডকাস্টিং পেজে বর্ণনা করা হয়েছে।

কল করুন

আরও দেখুন XlaBuilder::Call

প্রদত্ত আর্গুমেন্টগুলো ব্যবহার করে একটি গণনা শুরু করে।

Call(computation, operands...)

| যুক্তি | প্রকার | শব্দার্থবিদ্যা |

|---|---|---|

computation | XlaComputation | যেকোনো ধরনের N সংখ্যক প্যারামিটার সহ T_0, T_1, ..., T_{N-1} -> S ধরনের গণনা। |

operands | N সংখ্যক XlaOp এর ক্রম | যেকোনো ধরনের N সংখ্যক আর্গুমেন্ট |

operands অ্যারিটি এবং টাইপ অবশ্যই computation প্যারামিটারগুলোর সাথে মিলতে হবে। কোনো operands না থাকলেও চলবে।

কম্পোজিটকল

আরও দেখুন XlaBuilder::CompositeCall ।

এটি অন্যান্য StableHLO অপারেশন দ্বারা গঠিত একটি অপারেশনকে এনক্যাপসুলেট করে, যা ইনপুট ও কম্পোজিট_অ্যাট্রিবিউট গ্রহণ করে এবং ফলাফল তৈরি করে। এই অপারেশনের অর্থ ডিকম্পোজিশন অ্যাট্রিবিউটের মাধ্যমে বাস্তবায়িত হয়। প্রোগ্রামের অর্থ পরিবর্তন না করেই কম্পোজিট অপারেশনটিকে তার ডিকম্পোজিশন দ্বারা প্রতিস্থাপন করা যায়। যেসব ক্ষেত্রে ডিকম্পোজিশন ইনলাইন করলে একই অপারেশন অর্থ পাওয়া যায় না, সেখানে কাস্টম_কল ব্যবহার করা শ্রেয়।

ভার্সন ফিল্ডটি (ডিফল্ট মান ০) কোনো যৌগিক শব্দের অর্থ কখন পরিবর্তিত হয় তা বোঝাতে ব্যবহৃত হয়।

এই অপটি is_composite=true অ্যাট্রিবিউট সহ একটি kCall হিসেবে প্রয়োগ করা হয়েছে। decomposition ফিল্ডটি computation অ্যাট্রিবিউটের মাধ্যমে নির্দিষ্ট করা হয়। ফ্রন্টএন্ড অ্যাট্রিবিউটগুলো composite.

কম্পোজিটকল অপের উদাহরণ:

f32[] call(f32[] %cst), to_apply=%computation, is_composite=true,

frontend_attributes = {

composite.name="foo.bar",

composite.attributes={n = 1 : i32, tensor = dense<1> : tensor<i32>},

composite.version="1"

}

CompositeCall(computation, operands..., name, attributes, version)

| যুক্তি | প্রকার | শব্দার্থবিদ্যা |

|---|---|---|

computation | XlaComputation | যেকোনো ধরনের N সংখ্যক প্যারামিটার সহ T_0, T_1, ..., T_{N-1} -> S ধরনের গণনা। |

operands | N সংখ্যক XlaOp এর ক্রম | পরিবর্তনশীল সংখ্যক মান |

name | string | যৌগটির নাম |

attributes | ঐচ্ছিক string | বৈশিষ্ট্যগুলির ঐচ্ছিক স্ট্রিং-রূপান্তরিত অভিধান |

version | ঐচ্ছিক int64 | যৌগিক অপের শব্দার্থের সংস্করণ আপডেটের সংখ্যা |

একটি অপারেশনের decomposition কোনো ফিল্ড নয়, বরং এটি একটি to_apply অ্যাট্রিবিউট হিসেবে থাকে যা নিম্ন-স্তরের ইমপ্লিমেন্টেশন ধারণকারী ফাংশনটিকে নির্দেশ করে, অর্থাৎ to_apply=%funcname

যৌগ এবং বিয়োজন সম্পর্কে আরও তথ্য StableHLO স্পেসিফিকেশন- এ পাওয়া যাবে।

সিবিআরটি

আরও দেখুন XlaBuilder::Cbrt ।

উপাদান-ভিত্তিক ঘনমূল অপারেশন x -> cbrt(x) .

Cbrt(operand)

| যুক্তি | প্রকার | শব্দার্থবিদ্যা |

|---|---|---|

operand | XlaOp | ফাংশনের অপারেন্ড |

Cbrt ঐচ্ছিক result_accuracy আর্গুমেন্টটিও সমর্থন করে:

Cbrt(operand, result_accuracy)

| যুক্তি | প্রকার | শব্দার্থবিদ্যা |

|---|---|---|

operand | XlaOp | ফাংশনের অপারেন্ড |

result_accuracy | ঐচ্ছিক ResultAccuracy | একাধিক বাস্তবায়ন সহ ইউনারি অপস-এর জন্য ব্যবহারকারী যে ধরনের নির্ভুলতার অনুরোধ করতে পারেন |

result_accuracy সম্পর্কে আরও তথ্যের জন্য Result Accuracy দেখুন।

StableHLO তথ্যের জন্য StableHLO - cbrt দেখুন।

ছাদ

আরও দেখুন XlaBuilder::Ceil ।

উপাদান-ভিত্তিক ceil x -> ⌈x⌉ .

Ceil(operand)

| যুক্তি | প্রকার | শব্দার্থবিদ্যা |

|---|---|---|

operand | XlaOp | ফাংশনের অপারেন্ড |

StableHLO তথ্যের জন্য StableHLO - ceil দেখুন।

কোলেস্কি

আরও দেখুন XlaBuilder::Cholesky ।

একগুচ্ছ প্রতিসম (হারমিশিয়ান) ধনাত্মক নির্দিষ্ট ম্যাট্রিক্সের কোলেস্কি ডিকম্পোজিশন গণনা করে।

Cholesky(a, lower)

| যুক্তি | প্রকার | শব্দার্থবিদ্যা |

|---|---|---|

a | XlaOp | ২-এর বেশি মাত্রা বিশিষ্ট একটি জটিল বা ফ্লোটিং-পয়েন্ট টাইপের অ্যারে। |

lower | bool | a ডটের উপরের না নিচের ত্রিভুজ ব্যবহার করতে হবে। |

যদি lower true হয়, তাহলে এমন নিম্ন-ত্রিভুজাকার ম্যাট্রিক্স l গণনা করে যেন $a = l . l^T$ হয়। যদি lower false হয়, তাহলে এমন উচ্চ-ত্রিভুজাকার ম্যাট্রিক্স u গণনা করে যেন\(a = u^T . u\).

lower এর মানের উপর নির্ভর করে, ইনপুট ডেটা শুধুমাত্র a এর নিম্ন/উচ্চ ত্রিভুজ থেকে পড়া হয়। অন্য ত্রিভুজের মান উপেক্ষা করা হয়। আউটপুট ডেটা একই ত্রিভুজে ফেরত দেওয়া হয়; অন্য ত্রিভুজের মানগুলো ইমপ্লিমেন্টেশন-সংজ্ঞায়িত এবং যেকোনো কিছুই হতে পারে।

যদি a ২টির বেশি ডাইমেনশন থাকে, তবে a ম্যাট্রিক্সের একটি ব্যাচ হিসেবে গণ্য করা হয়, যেখানে ক্ষুদ্রতম ২টি ডাইমেনশন ছাড়া বাকি সবগুলোই ব্যাচ ডাইমেনশন।

যদি a প্রতিসম (হারমিশিয়ান) পজিটিভ ডেফিনিট না হয়, তাহলে ফলাফলটি ইমপ্লিমেন্টেশন-ডিফাইন্ড হবে।

StableHLO তথ্যের জন্য StableHLO - cholesky দেখুন।

ক্ল্যাম্প

আরও দেখুন XlaBuilder::Clamp ।

একটি অপারেন্ডকে সর্বনিম্ন এবং সর্বোচ্চ মানের মধ্যবর্তী সীমার মধ্যে সীমাবদ্ধ করে।

Clamp(min, operand, max)

| যুক্তি | প্রকার | শব্দার্থবিদ্যা |

|---|---|---|

min | XlaOp | T টাইপের অ্যারে |

operand | XlaOp | T টাইপের অ্যারে |

max | XlaOp | T টাইপের অ্যারে |

একটি অপারেন্ড এবং সর্বনিম্ন ও সর্বোচ্চ মান দেওয়া থাকলে, যদি অপারেন্ডটি সর্বনিম্ন ও সর্বোচ্চ মানের মধ্যবর্তী পরিসরে থাকে তবে সেটিই রিটার্ন করে; অন্যথায়, অপারেন্ডটি এই পরিসরের নিচে থাকলে সর্বনিম্ন মানটি এবং উপরে থাকলে সর্বোচ্চ মানটি রিটার্ন করে। অর্থাৎ, clamp(a, x, b) = min(max(a, x), b) ।

তিনটি অ্যারেরই আকৃতি একই হতে হবে। বিকল্পভাবে, ব্রডকাস্টিং- এর একটি সীমাবদ্ধ রূপ হিসেবে, min এবং/অথবা max T টাইপের একটি স্কেলার হতে পারে।

স্কেলার min এবং max উদাহরণ:

let operand: s32[3] = {-1, 5, 9};

let min: s32 = 0;

let max: s32 = 6;

==>

Clamp(min, operand, max) = s32[3]{0, 5, 6};

StableHLO তথ্যের জন্য StableHLO - clamp দেখুন।

ভেঙে পড়া

আরও দেখুন XlaBuilder::Collapse . এবং tf.reshape অপারেশন।

একটি অ্যারের মাত্রাগুলোকে সংকুচিত করে একমাত্রিক মাত্রায় পরিণত করে।

Collapse(operand, dimensions)

| যুক্তি | প্রকার | শব্দার্থবিদ্যা |

|---|---|---|

operand | XlaOp | T টাইপের অ্যারে |

dimensions | int64 ভেক্টর | T-এর মাত্রাগুলোর একটি ক্রমিক, ধারাবাহিক উপসেট। |

Collapse অপারেটরটি অপারেন্ডের ডাইমেনশনগুলোর প্রদত্ত সাবসেটকে একটিমাত্র ডাইমেনশন দ্বারা প্রতিস্থাপন করে। এর ইনপুট আর্গুমেন্টগুলো হলো T টাইপের একটি যথেচ্ছ অ্যারে এবং ডাইমেনশন ইনডেক্সগুলোর একটি কম্পাইল-টাইম-কনস্ট্যান্ট ভেক্টর। ডাইমেনশন ইনডেক্সগুলো অবশ্যই T-এর ডাইমেনশনগুলোর একটি ক্রমানুসারে (নিম্ন থেকে উচ্চ ডাইমেনশন সংখ্যা) সাজানো ধারাবাহিক সাবসেট হতে হবে। সুতরাং, {0, 1, 2}, {0, 1}, বা {1, 2} সবগুলোই বৈধ ডাইমেনশন সেট, কিন্তু {1, 0} বা {0, 2} বৈধ নয়। এগুলোকে একটিমাত্র নতুন ডাইমেনশন দ্বারা প্রতিস্থাপন করা হয়, যা ডাইমেনশন সিকোয়েন্সে প্রতিস্থাপিত ডাইমেনশনগুলোর একই অবস্থানে থাকে এবং নতুন ডাইমেনশনের আকার মূল ডাইমেনশনগুলোর আকারের গুণফলের সমান হয়। dimensions মধ্যে সর্বনিম্ন ডাইমেনশন সংখ্যাটি হলো লুপ নেস্টের সবচেয়ে ধীর পরিবর্তনশীল ডাইমেনশন (মোস্ট মেজর), এবং সর্বোচ্চ ডাইমেনশন সংখ্যাটি হলো সবচেয়ে দ্রুত পরিবর্তনশীল (মোস্ট মাইনর)। আরও সাধারণ কলাপস অর্ডারিংয়ের প্রয়োজন হলে tf.reshape অপারেটরটি দেখুন।

উদাহরণস্বরূপ, ধরা যাক v হলো ২৪টি উপাদান বিশিষ্ট একটি অ্যারে:

let v = f32[4x2x3] { { {10, 11, 12}, {15, 16, 17} },

{ {20, 21, 22}, {25, 26, 27} },

{ {30, 31, 32}, {35, 36, 37} },

{ {40, 41, 42}, {45, 46, 47} } };

// Collapse to a single dimension, leaving one dimension.

let v012 = Collapse(v, {0,1,2});

then v012 == f32[24] {10, 11, 12, 15, 16, 17,

20, 21, 22, 25, 26, 27,

30, 31, 32, 35, 36, 37,

40, 41, 42, 45, 46, 47};

// Collapse the two lower dimensions, leaving two dimensions.

let v01 = Collapse(v, {0,1});

then v01 == f32[4x6] { {10, 11, 12, 15, 16, 17},

{20, 21, 22, 25, 26, 27},

{30, 31, 32, 35, 36, 37},

{40, 41, 42, 45, 46, 47} };

// Collapse the two higher dimensions, leaving two dimensions.

let v12 = Collapse(v, {1,2});

then v12 == f32[8x3] { {10, 11, 12},

{15, 16, 17},

{20, 21, 22},

{25, 26, 27},

{30, 31, 32},

{35, 36, 37},

{40, 41, 42},

{45, 46, 47} };

Clz

আরও দেখুন XlaBuilder::Clz ।

প্রতিটি উপাদানের শুরুতে থাকা শূন্যগুলো গণনা করুন।

Clz(operand)

| যুক্তি | প্রকার | শব্দার্থবিদ্যা |

|---|---|---|

operand | XlaOp | ফাংশনের অপারেন্ড |

কালেক্টিভ ব্রডকাস্ট

আরও দেখুন XlaBuilder::CollectiveBroadcast ।

রেপ্লিকাগুলোর মধ্যে ডেটা ব্রডকাস্ট করে। প্রতিটি গ্রুপের প্রথম রেপ্লিকা আইডি থেকে একই গ্রুপের অন্যান্য আইডিগুলোতে ডেটা পাঠানো হয়। যদি কোনো রেপ্লিকা আইডি কোনো রেপ্লিকা গ্রুপে না থাকে, তাহলে সেই রেপ্লিকার আউটপুটটি . shape ০ (শূন্য) দ্বারা গঠিত একটি টেনসর হয়।

CollectiveBroadcast(operand, replica_groups, channel_id)

| যুক্তি | প্রকার | শব্দার্থবিদ্যা |

|---|---|---|

operand | XlaOp | ফাংশনের অপারেন্ড |

replica_groups | ReplicaGroup ভেক্টর | প্রতিটি গ্রুপে রেপ্লিকা আইডিগুলির একটি তালিকা থাকে। |

channel_id | ঐচ্ছিক ChannelHandle | প্রতিটি প্রেরণ/গ্রহণ জোড়ার জন্য অনন্য শনাক্তকারী |

StableHLO তথ্যের জন্য StableHLO - collective_broadcast দেখুন।

কালেক্টিভপারমিউট

আরও দেখুন XlaBuilder::CollectivePermute ।

CollectivePermute হলো একটি সম্মিলিত অপারেশন যা রেপ্লিকাগুলোর মধ্যে ডেটা আদান-প্রদান করে।

CollectivePermute(operand, source_target_pairs, channel_id)

| যুক্তি | প্রকার | শব্দার্থবিদ্যা |

|---|---|---|

operand | XlaOp | n মাত্রিক ইনপুট অ্যারে |

source_target_pairs | <int64, int64> ভেক্টর | (source_replica_id, target_replica_id) জোড়াগুলোর একটি তালিকা। প্রতিটি জোড়ার জন্য, অপারেন্ডটি সোর্স রেপ্লিকা থেকে টার্গেট রেপ্লিকাতে পাঠানো হয়। |

channel_id | ঐচ্ছিক ChannelHandle | আন্তঃ-মডিউল যোগাযোগের জন্য ঐচ্ছিক চ্যানেল আইডি |

উল্লেখ্য যে source_target_pairs এর উপর নিম্নলিখিত সীমাবদ্ধতাগুলো রয়েছে:

- যেকোনো দুটি পেয়ারের টার্গেট রেপ্লিকা আইডি এবং সোর্স রেপ্লিকা আইডি একই হওয়া উচিত নয়।

- যদি কোনো রেপ্লিকা আইডি কোনো জোড়ার টার্গেট না হয়, তাহলে সেই রেপ্লিকার আউটপুটটি ইনপুটের আকারের সমান আকৃতির ০ (শূন্য) দ্বারা গঠিত একটি টেনসর হবে।

CollectivePermute অপারেশনের API অভ্যন্তরীণভাবে দুটি HLO নির্দেশাবলীতে ( CollectivePermuteStart এবং CollectivePermuteDone ) বিভক্ত।

আরও দেখুন HloInstruction::CreateCollectivePermuteStart ।

CollectivePermuteStart এবং CollectivePermuteDone HLO-তে প্রিমিটিভ হিসেবে কাজ করে। এই অপসগুলো HLO ডাম্পে দেখা যেতে পারে, কিন্তু এগুলো সাধারণ ব্যবহারকারীদের দ্বারা ম্যানুয়ালি তৈরি করার জন্য নয়।

StableHLO তথ্যের জন্য StableHLO - collective_permute দেখুন।

তুলনা করুন

আরও দেখুন XlaBuilder::Compare ।

নিম্নলিখিতগুলির lhs এবং rhs উপাদানভিত্তিক তুলনা করে:

সমীকরণ

আরও দেখুন XlaBuilder::Eq ।

lhs এবং rhs প্রতিটি উপাদানের মধ্যে সমান তুলনা করে।

\(lhs = rhs\)

Eq(lhs, rhs)

| যুক্তি | প্রকার | শব্দার্থবিদ্যা |

|---|---|---|

| বাম পাশ | XlaOp | Left-hand-side operand: array of type T |

| rhs | XlaOp | Left-hand-side operand: array of type T |

The arguments' shapes have to be either similar or compatible. See the broadcasting documentation about what it means for shapes to be compatible. The result of an operation has a shape which is the result of broadcasting the two input arrays. In this variant, operations between arrays of different ranks are not supported, unless one of the operands is a scalar.

An alternative variant with different-dimensional broadcasting support exists for Eq:

Eq(lhs,rhs, broadcast_dimensions)

| যুক্তি | প্রকার | শব্দার্থবিদ্যা |

|---|---|---|

| lhs | XlaOp | Left-hand-side operand: array of type T |

| rhs | XlaOp | Left-hand-side operand: array of type T |

| broadcast_dimension | ArraySlice | Which dimension in the target shape each dimension of the operand shape corresponds to |

This variant of the operation should be used for arithmetic operations between arrays of different ranks (such as adding a matrix to a vector).

The additional broadcast_dimensions operand is a slice of integers specifying the dimensions to use for broadcasting the operands. The semantics are described in detail on the broadcasting page .

Support a total order over the floating point numbers exists for Eq, by enforcing:

\[-NaN < -Inf < -Finite < -0 < +0 < +Finite < +Inf < +NaN.\]

EqTotalOrder(lhs,rhs, broadcast_dimensions)

| যুক্তি | প্রকার | শব্দার্থবিদ্যা |

|---|---|---|

| lhs | XlaOp | Left-hand-side operand: array of type T |

| rhs | XlaOp | Left-hand-side operand: array of type T |

| broadcast_dimension | ArraySlice | Which dimension in the target shape each dimension of the operand shape corresponds to |

For StableHLO information see StableHLO - compare .

নে

See also XlaBuilder::Ne .

Performs element-wise not equal-to comparison of lhs and rhs .

\(lhs != rhs\)

Ne(lhs, rhs)

| যুক্তি | প্রকার | শব্দার্থবিদ্যা |

|---|---|---|

| lhs | XlaOp | Left-hand-side operand: array of type T |

| rhs | XlaOp | Left-hand-side operand: array of type T |

The arguments' shapes have to be either similar or compatible. See the broadcasting documentation about what it means for shapes to be compatible. The result of an operation has a shape which is the result of broadcasting the two input arrays. In this variant, operations between arrays of different ranks are not supported, unless one of the operands is a scalar.

An alternative variant with different-dimensional broadcasting support exists for Ne:

Ne(lhs,rhs, broadcast_dimensions)

| যুক্তি | প্রকার | শব্দার্থবিদ্যা |

|---|---|---|

| lhs | XlaOp | Left-hand-side operand: array of type T |

| rhs | XlaOp | Left-hand-side operand: array of type T |

| broadcast_dimension | ArraySlice | Which dimension in the target shape each dimension of the operand shape corresponds to |

This variant of the operation should be used for arithmetic operations between arrays of different ranks (such as adding a matrix to a vector).

The additional broadcast_dimensions operand is a slice of integers specifying the dimensions to use for broadcasting the operands. The semantics are described in detail on the broadcasting page .

Support a total order over the floating point numbers exists for Ne, by enforcing:

\[-NaN < -Inf < -Finite < -0 < +0 < +Finite < +Inf < +NaN.\]

NeTotalOrder(lhs,rhs, broadcast_dimensions)

| যুক্তি | প্রকার | শব্দার্থবিদ্যা |

|---|---|---|

| lhs | XlaOp | Left-hand-side operand: array of type T |

| rhs | XlaOp | Left-hand-side operand: array of type T |

| broadcast_dimension | ArraySlice | Which dimension in the target shape each dimension of the operand shape corresponds to |

For StableHLO information see StableHLO - compare .

জি

See also XlaBuilder::Ge .

Performs element-wise greater-or-equal-than comparison of lhs and rhs .

\(lhs >= rhs\)

Ge(lhs, rhs)

| যুক্তি | প্রকার | শব্দার্থবিদ্যা |

|---|---|---|

| lhs | XlaOp | Left-hand-side operand: array of type T |

| rhs | XlaOp | Left-hand-side operand: array of type T |

The arguments' shapes have to be either similar or compatible. See the broadcasting documentation about what it means for shapes to be compatible. The result of an operation has a shape which is the result of broadcasting the two input arrays. In this variant, operations between arrays of different ranks are not supported, unless one of the operands is a scalar.

An alternative variant with different-dimensional broadcasting support exists for Ge:

Ge(lhs,rhs, broadcast_dimensions)

| যুক্তি | প্রকার | শব্দার্থবিদ্যা |

|---|---|---|

| lhs | XlaOp | Left-hand-side operand: array of type T |

| rhs | XlaOp | Left-hand-side operand: array of type T |

| broadcast_dimension | ArraySlice | Which dimension in the target shape each dimension of the operand shape corresponds to |

This variant of the operation should be used for arithmetic operations between arrays of different ranks (such as adding a matrix to a vector).

The additional broadcast_dimensions operand is a slice of integers specifying the dimensions to use for broadcasting the operands. The semantics are described in detail on the broadcasting page .

Support a total order over the floating point numbers exists for Gt, by enforcing:

\[-NaN < -Inf < -Finite < -0 < +0 < +Finite < +Inf < +NaN.\]

GtTotalOrder(lhs,rhs, broadcast_dimensions)

| যুক্তি | প্রকার | শব্দার্থবিদ্যা |

|---|---|---|

| lhs | XlaOp | Left-hand-side operand: array of type T |

| rhs | XlaOp | Left-hand-side operand: array of type T |

| broadcast_dimension | ArraySlice | Which dimension in the target shape each dimension of the operand shape corresponds to |

For StableHLO information see StableHLO - compare .

Gt

See also XlaBuilder::Gt .

Performs element-wise greater-than comparison of lhs and rhs .

\(lhs > rhs\)

Gt(lhs, rhs)

| যুক্তি | প্রকার | শব্দার্থবিদ্যা |

|---|---|---|

| lhs | XlaOp | Left-hand-side operand: array of type T |

| rhs | XlaOp | Left-hand-side operand: array of type T |

The arguments' shapes have to be either similar or compatible. See the broadcasting documentation about what it means for shapes to be compatible. The result of an operation has a shape which is the result of broadcasting the two input arrays. In this variant, operations between arrays of different ranks are not supported, unless one of the operands is a scalar.

An alternative variant with different-dimensional broadcasting support exists for Gt:

Gt(lhs,rhs, broadcast_dimensions)

| যুক্তি | প্রকার | শব্দার্থবিদ্যা |

|---|---|---|

| lhs | XlaOp | Left-hand-side operand: array of type T |

| rhs | XlaOp | Left-hand-side operand: array of type T |

| broadcast_dimension | ArraySlice | Which dimension in the target shape each dimension of the operand shape corresponds to |

This variant of the operation should be used for arithmetic operations between arrays of different ranks (such as adding a matrix to a vector).

The additional broadcast_dimensions operand is a slice of integers specifying the dimensions to use for broadcasting the operands. The semantics are described in detail on the broadcasting page .

For StableHLO information see StableHLO - compare .

লে

See also XlaBuilder::Le .

Performs element-wise less-or-equal-than comparison of lhs and rhs .

\(lhs <= rhs\)

Le(lhs, rhs)

| যুক্তি | প্রকার | শব্দার্থবিদ্যা |

|---|---|---|

| lhs | XlaOp | Left-hand-side operand: array of type T |

| rhs | XlaOp | Left-hand-side operand: array of type T |

The arguments' shapes have to be either similar or compatible. See the broadcasting documentation about what it means for shapes to be compatible. The result of an operation has a shape which is the result of broadcasting the two input arrays. In this variant, operations between arrays of different ranks are not supported, unless one of the operands is a scalar.

An alternative variant with different-dimensional broadcasting support exists for Le:

Le(lhs,rhs, broadcast_dimensions)

| যুক্তি | প্রকার | শব্দার্থবিদ্যা |

|---|---|---|

| lhs | XlaOp | Left-hand-side operand: array of type T |

| rhs | XlaOp | Left-hand-side operand: array of type T |

| broadcast_dimension | ArraySlice | Which dimension in the target shape each dimension of the operand shape corresponds to |

This variant of the operation should be used for arithmetic operations between arrays of different ranks (such as adding a matrix to a vector).

The additional broadcast_dimensions operand is a slice of integers specifying the dimensions to use for broadcasting the operands. The semantics are described in detail on the broadcasting page .

Support a total order over the floating point numbers exists for Le, by enforcing:

\[-NaN < -Inf < -Finite < -0 < +0 < +Finite < +Inf < +NaN.\]

LeTotalOrder(lhs,rhs, broadcast_dimensions)

| যুক্তি | প্রকার | শব্দার্থবিদ্যা |

|---|---|---|

| lhs | XlaOp | Left-hand-side operand: array of type T |

| rhs | XlaOp | Left-hand-side operand: array of type T |

| broadcast_dimension | ArraySlice | Which dimension in the target shape each dimension of the operand shape corresponds to |

For StableHLO information see StableHLO - compare .

Lt

See also XlaBuilder::Lt .

Performs element-wise less-than comparison of lhs and rhs .

\(lhs < rhs\)

Lt(lhs, rhs)

| যুক্তি | প্রকার | শব্দার্থবিদ্যা |

|---|---|---|

| lhs | XlaOp | Left-hand-side operand: array of type T |

| rhs | XlaOp | Left-hand-side operand: array of type T |

The arguments' shapes have to be either similar or compatible. See the broadcasting documentation about what it means for shapes to be compatible. The result of an operation has a shape which is the result of broadcasting the two input arrays. In this variant, operations between arrays of different ranks are not supported, unless one of the operands is a scalar.

An alternative variant with different-dimensional broadcasting support exists for Lt:

Lt(lhs,rhs, broadcast_dimensions)

| যুক্তি | প্রকার | শব্দার্থবিদ্যা |

|---|---|---|

| lhs | XlaOp | Left-hand-side operand: array of type T |

| rhs | XlaOp | Left-hand-side operand: array of type T |

| broadcast_dimension | ArraySlice | Which dimension in the target shape each dimension of the operand shape corresponds to |

This variant of the operation should be used for arithmetic operations between arrays of different ranks (such as adding a matrix to a vector).

The additional broadcast_dimensions operand is a slice of integers specifying the dimensions to use for broadcasting the operands. The semantics are described in detail on the broadcasting page .

Support a total order over the floating point numbers exists for Lt, by enforcing:

\[-NaN < -Inf < -Finite < -0 < +0 < +Finite < +Inf < +NaN.\]

LtTotalOrder(lhs,rhs, broadcast_dimensions)

| যুক্তি | প্রকার | শব্দার্থবিদ্যা |

|---|---|---|

| lhs | XlaOp | Left-hand-side operand: array of type T |

| rhs | XlaOp | Left-hand-side operand: array of type T |

| broadcast_dimension | ArraySlice | Which dimension in the target shape each dimension of the operand shape corresponds to |

For StableHLO information see StableHLO - compare .

জটিল

See also XlaBuilder::Complex .

Performs element-wise conversion to a complex value from a pair of real and imaginary values, lhs and rhs .

Complex(lhs, rhs)

| যুক্তি | প্রকার | শব্দার্থবিদ্যা |

|---|---|---|

| lhs | XlaOp | Left-hand-side operand: array of type T |

| rhs | XlaOp | Left-hand-side operand: array of type T |

The arguments' shapes have to be either similar or compatible. See the broadcasting documentation about what it means for shapes to be compatible. The result of an operation has a shape which is the result of broadcasting the two input arrays. In this variant, operations between arrays of different ranks are not supported, unless one of the operands is a scalar.

An alternative variant with different-dimensional broadcasting support exists for Complex:

Complex(lhs,rhs, broadcast_dimensions)

| যুক্তি | প্রকার | শব্দার্থবিদ্যা |

|---|---|---|

| lhs | XlaOp | Left-hand-side operand: array of type T |

| rhs | XlaOp | Left-hand-side operand: array of type T |

| broadcast_dimension | ArraySlice | Which dimension in the target shape each dimension of the operand shape corresponds to |

This variant of the operation should be used for arithmetic operations between arrays of different ranks (such as adding a matrix to a vector).

The additional broadcast_dimensions operand is a slice of integers specifying the dimensions to use for broadcasting the operands. The semantics are described in detail on the broadcasting page .

For StableHLO information see StableHLO - complex .

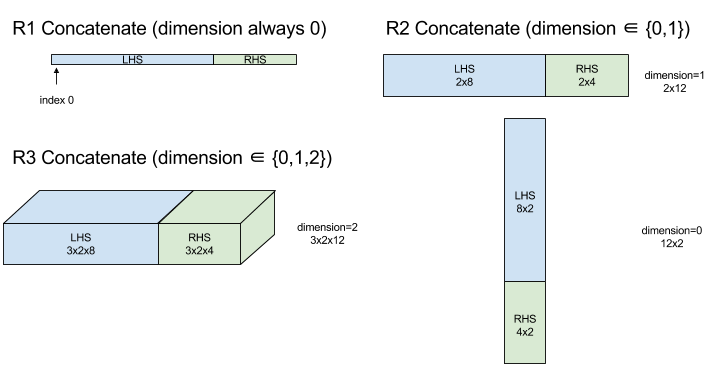

ConcatInDim (Concatenate)

See also XlaBuilder::ConcatInDim .

Concatenate composes an array from multiple array operands. The array has the same number of dimensions as each of the input array operands (which must have the same number of dimensions as each other) and contains the arguments in the order that they were specified.

Concatenate(operands..., dimension)

| যুক্তি | প্রকার | শব্দার্থবিদ্যা |

|---|---|---|

operands | sequence of N XlaOp | N arrays of type T with dimensions [L0, L1, ...]. Requires N >= 1. |

dimension | int64 | A value in the interval [0, N) that names the dimension to be concatenated between the operands . |

With the exception of dimension all dimensions must be the same. This is because XLA does not support "ragged" arrays. Also note that 0-dimensional values cannot be concatenated (as it's impossible to name the dimension along which the concatenation occurs).

1-dimensional example:

Concat({ {2, 3}, {4, 5}, {6, 7} }, 0)

//Output: {2, 3, 4, 5, 6, 7}

2-dimensional example:

let a = { {1, 2},

{3, 4},

{5, 6} };

let b = { {7, 8} };

Concat({a, b}, 0)

//Output: { {1, 2},

// {3, 4},

// {5, 6},

// {7, 8} }

Diagram:

For StableHLO information see StableHLO - concatenate .

শর্তসাপেক্ষ

See also XlaBuilder::Conditional .

Conditional(predicate, true_operand, true_computation, false_operand, false_computation)

| যুক্তি | প্রকার | শব্দার্থবিদ্যা |

|---|---|---|

predicate | XlaOp | Scalar of type PRED |

true_operand | XlaOp | Argument of type \(T_0\) |

true_computation | XlaComputation | XlaComputation of type \(T_0 \to S\) |

false_operand | XlaOp | Argument of type \(T_1\) |

false_computation | XlaComputation | XlaComputation of type \(T_1 \to S\) |

Executes true_computation if predicate is true , false_computation if predicate is false , and returns the result.

The true_computation must take in a single argument of type \(T_0\) and will be invoked with true_operand which must be of the same type. The false_computation must take in a single argument of type \(T_1\) and will be invoked with false_operand which must be of the same type. The type of the returned value of true_computation and false_computation must be the same.

Note that only one of true_computation and false_computation will be executed depending on the value of predicate .

Conditional(branch_index, branch_computations, branch_operands)

| যুক্তি | প্রকার | শব্দার্থবিদ্যা |

|---|---|---|

branch_index | XlaOp | Scalar of type S32 |

branch_computations | sequence of N XlaComputation | XlaComputations of type \(T_0 \to S , T_1 \to S , ..., T_{N-1} \to S\) |

branch_operands | sequence of N XlaOp | Arguments of type \(T_0 , T_1 , ..., T_{N-1}\) |

Executes branch_computations[branch_index] , and returns the result. If branch_index is an S32 which is < 0 or >= N, then branch_computations[N-1] is executed as the default branch.

Each branch_computations[b] must take in a single argument of type \(T_b\) and will be invoked with branch_operands[b] which must be of the same type. The type of the returned value of each branch_computations[b] must be the same.

Note that only one of the branch_computations will be executed depending on the value of branch_index .

For StableHLO information see StableHLO - if .

ধ্রুবক

See also XlaBuilder::ConstantLiteral .

Produces an output from a constant literal .

Constant(literal)

| যুক্তি | প্রকার | শব্দার্থবিদ্যা |

|---|---|---|

literal | LiteralSlice | constant view of an existing Literal |

For StableHLO information see StableHLO - constant .

ConvertElementType

See also XlaBuilder::ConvertElementType .

Similar to an element-wise static_cast in C++, ConvertElementType performs an element-wise conversion operation from a data shape to a target shape. The dimensions must match, and the conversion is an element-wise one; eg s32 elements become f32 elements via an s32 -to- f32 conversion routine.

ConvertElementType(operand, new_element_type)

| যুক্তি | প্রকার | শব্দার্থবিদ্যা |

|---|---|---|

operand | XlaOp | array of type T with dims D |

new_element_type | PrimitiveType | type U |

The dimensions of the operand and the target shape must match. The source and destination element types must not be tuples.

A conversion such as T=s32 to U=f32 will perform a normalizing int-to-float conversion routine such as round-to-nearest-even.

let a: s32[3] = {0, 1, 2};

let b: f32[3] = convert(a, f32);

then b == f32[3]{0.0, 1.0, 2.0}

For StableHLO information see StableHLO - convert .

Conv (Convolution)

See also XlaBuilder::Conv .

Computes a convolution of the kind used in neural networks. Here, a convolution can be thought of as a n-dimensional window moving across a n-dimensional base area and a computation is performed for each possible position of the window.

Conv Enqueues a convolution instruction onto the computation, which uses the default convolution dimension numbers with no dilation.

The padding is specified in a short-hand way as either SAME or VALID. SAME padding pads the input ( lhs ) with zeroes so that the output has the same shape as the input when not taking striding into account. VALID padding simply means no padding.

Conv(lhs, rhs, window_strides, padding, feature_group_count, batch_group_count, precision_config, preferred_element_type)

| যুক্তি | প্রকার | শব্দার্থবিদ্যা |

|---|---|---|

lhs | XlaOp | (n+2)-dimensional array of inputs |

rhs | XlaOp | (n+2)-dimensional array of kernel weights |

window_strides | ArraySlice<int64> | nd array of kernel strides |

padding | Padding | enum of padding |

feature_group_count | int64 | the number of feature groups |

batch_group_count | int64 | the number of batch groups |

precision_config | optional PrecisionConfig | enum for level of precision |

preferred_element_type | optional PrimitiveType | enum of scalar element type |

Increasing levels of controls are available for Conv :

Let n be the number of spatial dimensions. The lhs argument is an (n+2)-dimensional array describing the base area. This is called the input, even though of course the rhs is also an input. In a neural network, these are the input activations. The n+2 dimensions are, in this order:

-

batch: Each coordinate in this dimension represents an independent input for which convolution is carried out. -

z/depth/features: Each (y,x) position in the base area has a vector associated to it, which goes into this dimension. -

spatial_dims: Describes thenspatial dimensions that define the base area that the window moves across.

The rhs argument is an (n+2)-dimensional array describing the convolutional filter/kernel/window. The dimensions are, in this order:

-

output-z: Thezdimension of the output. -

input-z: The size of this dimension timesfeature_group_countshould equal the size of thezdimension in lhs. -

spatial_dims: Describes thenspatial dimensions that define the nd window that moves across the base area.

The window_strides argument specifies the stride of the convolutional window in the spatial dimensions. For example, if the stride in the first spatial dimension is 3, then the window can only be placed at coordinates where the first spatial index is divisible by 3.

The padding argument specifies the amount of zero padding to be applied to the base area. The amount of padding can be negative -- the absolute value of negative padding indicates the number of elements to remove from the specified dimension before doing the convolution. padding[0] specifies the padding for dimension y and padding[1] specifies the padding for dimension x . Each pair has the low padding as the first element and the high padding as the second element. The low padding is applied in the direction of lower indices while the high padding is applied in the direction of higher indices. For example, if padding[1] is (2,3) then there will be a padding by 2 zeroes on the left and by 3 zeroes on the right in the second spatial dimension. Using padding is equivalent to inserting those same zero values into the input ( lhs ) before doing the convolution.

The lhs_dilation and rhs_dilation arguments specify the dilation factor to be applied to the lhs and rhs, respectively, in each spatial dimension. If the dilation factor in a spatial dimension is d, then d-1 holes are implicitly placed between each of the entries in that dimension, increasing the size of the array. The holes are filled with a no-op value, which for convolution means zeroes.

Dilation of the rhs is also called atrous convolution. For more details, see tf.nn.atrous_conv2d . Dilation of the lhs is also called transposed convolution. For more details, see tf.nn.conv2d_transpose .

The feature_group_count argument (default value 1) can be used for grouped convolutions. feature_group_count needs to be a divisor of both the input and the output feature dimension. If feature_group_count is greater than 1, it means that conceptually the input and output feature dimension and the rhs output feature dimension are split evenly into many feature_group_count groups, each group consisting of a consecutive subsequence of features. The input feature dimension of rhs needs to be equal to the lhs input feature dimension divided by feature_group_count (so it already has the size of a group of input features). The i-th groups are used together to compute feature_group_count for many separate convolutions. The results of these convolutions are concatenated together in the output feature dimension.

For depthwise convolution the feature_group_count argument would be set to the input feature dimension, and the filter would be reshaped from [filter_height, filter_width, in_channels, channel_multiplier] to [filter_height, filter_width, 1, in_channels * channel_multiplier] . For more details, see tf.nn.depthwise_conv2d .

The batch_group_count (default value 1) argument can be used for grouped filters during backpropagation. batch_group_count needs to be a divisor of the size of the lhs (input) batch dimension. If batch_group_count is greater than 1, it means that the output batch dimension should be of size input batch / batch_group_count . The batch_group_count must be a divisor of the output feature size.

The output shape has these dimensions, in this order:

-

batch: The size of this dimension timesbatch_group_countshould equal the size of thebatchdimension in lhs. -

z: Same size asoutput-zon the kernel (rhs). -

spatial_dims: One value for each valid placement of the convolutional window.

The figure above shows how the batch_group_count field works. Effectively, we slice each lhs batch into batch_group_count groups, and do the same for the output features. Then, for each of these groups we do pairwise convolutions and concatenate the output along the output feature dimension. The operational semantics of all the other dimensions (feature and spatial) remain the same.

The valid placements of the convolutional window are determined by the strides and the size of the base area after padding.

To describe what a convolution does, consider a 2d convolution, and pick some fixed batch , z , y , x coordinates in the output. Then (y,x) is a position of a corner of the window within the base area (eg the upper left corner, depending on how you interpret the spatial dimensions). We now have a 2d window, taken from the base area, where each 2d point is associated to a 1d vector, so we get a 3d box. From the convolutional kernel, since we fixed the output coordinate z , we also have a 3d box. The two boxes have the same dimensions, so we can take the sum of the element-wise products between the two boxes (similar to a dot product). That is the output value.

Note that if output-z is eg, 5, then each position of the window produces 5 values in the output into the z dimension of the output. These values differ in what part of the convolutional kernel is used - there is a separate 3d box of values used for each output-z coordinate. So you could think of it as 5 separate convolutions with a different filter for each of them.

Here is pseudo-code for a 2d convolution with padding and striding:

for (b, oz, oy, ox) { // output coordinates

value = 0;

for (iz, ky, kx) { // kernel coordinates and input z

iy = oy*stride_y + ky - pad_low_y;

ix = ox*stride_x + kx - pad_low_x;

if ((iy, ix) inside the base area considered without padding) {

value += input(b, iz, iy, ix) * kernel(oz, iz, ky, kx);

}

}

output(b, oz, oy, ox) = value;

}

precision_config is used to indicate the precision configuration. The level dictates whether hardware should attempt to generate more machine code instructions to provide more accurate dtype emulation when needed (ie emulating f32 on a TPU that only supports bf16 matmuls). Values may be DEFAULT , HIGH , HIGHEST . Additional details in the MXU sections .

preferred_element_type is a scalar element of higher/lower precision output types used for accumulation. preferred_element_type recommends the accumulation type for the given operation, however it is not guaranteed. This allows for some hardware backends to instead accumulate in a different type and convert to the preferred output type.

For StableHLO information see StableHLO - convolution .

ConvWithGeneralPadding

See also XlaBuilder::ConvWithGeneralPadding .

ConvWithGeneralPadding(lhs, rhs, window_strides, padding, feature_group_count, batch_group_count, precision_config, preferred_element_type)

Same as Conv where padding configuration is explicit.

| যুক্তি | প্রকার | শব্দার্থবিদ্যা |

|---|---|---|

lhs | XlaOp | (n+2)-dimensional array of inputs |

rhs | XlaOp | (n+2)-dimensional array of kernel weights |

window_strides | ArraySlice<int64> | nd array of kernel strides |

padding | ArraySlice< pair<int64,int64>> | nd array of (low, high) padding |

feature_group_count | int64 | the number of feature groups |

batch_group_count | int64 | the number of batch groups |

precision_config | optional PrecisionConfig | enum for level of precision |

preferred_element_type | optional PrimitiveType | enum of scalar element type |

ConvWithGeneralDimensions

See also XlaBuilder::ConvWithGeneralDimensions .

ConvWithGeneralDimensions(lhs, rhs, window_strides, padding, dimension_numbers, feature_group_count, batch_group_count, precision_config, preferred_element_type)

Same as Conv where dimension numbers are explicit.

| যুক্তি | প্রকার | শব্দার্থবিদ্যা |

|---|---|---|

lhs | XlaOp | (n+2)-dimensional array of inputs |

rhs | XlaOp | (n+2)-dimensional array of kernel weights |

window_strides | ArraySlice<int64> | nd array of kernel strides |

padding | Padding | enum of padding |

dimension_numbers | ConvolutionDimensionNumbers | the number of dimensions |

feature_group_count | int64 | the number of feature groups |

batch_group_count | int64 | the number of batch groups |

precision_config | optional PrecisionConfig | enum for level of precision |

preferred_element_type | optional PrimitiveType | enum of scalar element type |

ConvGeneral

See also XlaBuilder::ConvGeneral .

ConvGeneral(lhs, rhs, window_strides, padding, dimension_numbers, feature_group_count, batch_group_count, precision_config, preferred_element_type)

Same as Conv where dimension numbers and padding configuration is explicit

| যুক্তি | প্রকার | শব্দার্থবিদ্যা |

|---|---|---|

lhs | XlaOp | (n+2)-dimensional array of inputs |

rhs | XlaOp | (n+2)-dimensional array of kernel weights |

window_strides | ArraySlice<int64> | nd array of kernel strides |

padding | ArraySlice< pair<int64,int64>> | nd array of (low, high) padding |

dimension_numbers | ConvolutionDimensionNumbers | the number of dimensions |

feature_group_count | int64 | the number of feature groups |

batch_group_count | int64 | the number of batch groups |

precision_config | optional PrecisionConfig | enum for level of precision |

preferred_element_type | optional PrimitiveType | enum of scalar element type |

ConvGeneralDilated

See also XlaBuilder::ConvGeneralDilated .

ConvGeneralDilated(lhs, rhs, window_strides, padding, lhs_dilation, rhs_dilation, dimension_numbers, feature_group_count, batch_group_count, precision_config, preferred_element_type, window_reversal)

Same as Conv where padding configuration, dilation factors, and dimension numbers are explicit.

| যুক্তি | প্রকার | শব্দার্থবিদ্যা |

|---|---|---|

lhs | XlaOp | (n+2)-dimensional array of inputs |

rhs | XlaOp | (n+2)-dimensional array of kernel weights |

window_strides | ArraySlice<int64> | nd array of kernel strides |

padding | ArraySlice< pair<int64,int64>> | nd array of (low, high) padding |

lhs_dilation | ArraySlice<int64> | nd lhs dilation factor array |

rhs_dilation | ArraySlice<int64> | nd rhs dilation factor array |

dimension_numbers | ConvolutionDimensionNumbers | the number of dimensions |

feature_group_count | int64 | the number of feature groups |

batch_group_count | int64 | the number of batch groups |

precision_config | optional PrecisionConfig | enum for level of precision |

preferred_element_type | optional PrimitiveType | enum of scalar element type |

window_reversal | optional vector<bool> | flag used to logically reverse dimension before applying the convolution |

অনুলিপি

See also HloInstruction::CreateCopyStart .

Copy is internally decomposed into 2 HLO instructions CopyStart and CopyDone . Copy along with CopyStart and CopyDone serve as primitives in HLO. These ops may appear in HLO dumps, but they are not intended to be constructed manually by end users.

Cos

See also XlaBuilder::Cos .

Element-wise cosine x -> cos(x) .

Cos(operand)

| যুক্তি | প্রকার | শব্দার্থবিদ্যা |

|---|---|---|

operand | XlaOp | The operand to the function |

Cos also supports the optional result_accuracy argument:

Cos(operand, result_accuracy)

| যুক্তি | প্রকার | শব্দার্থবিদ্যা |

|---|---|---|

operand | XlaOp | The operand to the function |

result_accuracy | optional ResultAccuracy | The types of accuracy the user can request for unary ops with multiple implementations |

For more information on result_accuracy see Result Accuracy .

For StableHLO information see StableHLO - cosine .

Cosh

See also XlaBuilder::Cosh .

Element-wise hyperbolic cosine x -> cosh(x) .

Cosh(operand)

| যুক্তি | প্রকার | শব্দার্থবিদ্যা |

|---|---|---|

operand | XlaOp | The operand to the function |

Cosh also supports the optional result_accuracy argument:

Cosh(operand, result_accuracy)

| যুক্তি | প্রকার | শব্দার্থবিদ্যা |

|---|---|---|

operand | XlaOp | The operand to the function |

result_accuracy | optional ResultAccuracy | The types of accuracy the user can request for unary ops with multiple implementations |

For more information on result_accuracy see Result Accuracy .

CustomCall

See also XlaBuilder::CustomCall .

Call a user-provided function within a computation.

CustomCall documentation is provided in Developer details - XLA Custom Calls

For StableHLO information see StableHLO - custom_call .

বিভাগ

See also XlaBuilder::Div .

Performs element-wise division of dividend lhs and divisor rhs .

Div(lhs, rhs)

| যুক্তি | প্রকার | শব্দার্থবিদ্যা |

|---|---|---|

| lhs | XlaOp | Left-hand-side operand: array of type T |

| rhs | XlaOp | Left-hand-side operand: array of type T |

Integer division overflow (signed/unsigned division/remainder by zero or signed division/remainder of INT_SMIN with -1 ) produces an implementation defined value.

The arguments' shapes have to be either similar or compatible. See the broadcasting documentation about what it means for shapes to be compatible. The result of an operation has a shape which is the result of broadcasting the two input arrays. In this variant, operations between arrays of different ranks are not supported, unless one of the operands is a scalar.

An alternative variant with different-dimensional broadcasting support exists for Div:

Div(lhs,rhs, broadcast_dimensions)

| যুক্তি | প্রকার | শব্দার্থবিদ্যা |

|---|---|---|

| lhs | XlaOp | Left-hand-side operand: array of type T |

| rhs | XlaOp | Left-hand-side operand: array of type T |

| broadcast_dimension | ArraySlice | Which dimension in the target shape each dimension of the operand shape corresponds to |

This variant of the operation should be used for arithmetic operations between arrays of different ranks (such as adding a matrix to a vector).

The additional broadcast_dimensions operand is a slice of integers specifying the dimensions to use for broadcasting the operands. The semantics are described in detail on the broadcasting page .

For StableHLO information see StableHLO - divide .

ডোমেইন

See also HloInstruction::CreateDomain .

Domain may appear in HLO dumps, but it is not intended to be constructed manually by end users.

Dot

See also XlaBuilder::Dot .

Dot(lhs, rhs, precision_config, preferred_element_type)

| যুক্তি | প্রকার | শব্দার্থবিদ্যা |

|---|---|---|

lhs | XlaOp | array of type T |

rhs | XlaOp | array of type T |

precision_config | optional PrecisionConfig | enum for level of precision |

preferred_element_type | optional PrimitiveType | enum of scalar element type |

The exact semantics of this operation depend on the ranks of the operands:

| ইনপুট | আউটপুট | শব্দার্থবিদ্যা |

|---|---|---|

vector [n] dot vector [n] | স্কেলার | vector dot product |

matrix [mxk] dot vector [k] | vector [m] | matrix-vector multiplication |

matrix [mxk] dot matrix [kxn] | matrix [mxn] | matrix-matrix multiplication |

The operation performs sum of products over the second dimension of lhs (or the first if it has 1 dimension) and the first dimension of rhs . These are the "contracted" dimensions. The contracted dimensions of lhs and rhs must be of the same size. In practice, it can be used to perform dot products between vectors, vector/matrix multiplications or matrix/matrix multiplications.

precision_config is used to indicate the precision configuration. The level dictates whether hardware should attempt to generate more machine code instructions to provide more accurate dtype emulation when needed (ie emulating f32 on a TPU that only supports bf16 matmuls). Values may be DEFAULT , HIGH , HIGHEST . Additional details in the MXU sections .

preferred_element_type is a scalar element of higher/lower precision output types used for accumulation. preferred_element_type recommends the accumulation type for the given operation, however it is not guaranteed. This allows for some hardware backends to instead accumulate in a different type and convert to the preferred output type.

For StableHLO information see StableHLO - dot .

DotGeneral

See also XlaBuilder::DotGeneral .

DotGeneral(lhs, rhs, dimension_numbers, precision_config, preferred_element_type)

| যুক্তি | প্রকার | শব্দার্থবিদ্যা |

|---|---|---|

lhs | XlaOp | array of type T |

rhs | XlaOp | array of type T |

dimension_numbers | DotDimensionNumbers | contracting and batch dimension numbers |

precision_config | optional PrecisionConfig | enum for level of precision |

preferred_element_type | optional PrimitiveType | enum of scalar element type |

Similar to Dot, but allows contracting and batch dimension numbers to be specified for both the lhs and rhs .

| DotDimensionNumbers Fields | প্রকার | শব্দার্থবিদ্যা |

|---|---|---|

lhs_contracting_dimensions | repeated int64 | lhs contracting dimension numbers |

rhs_contracting_dimensions | repeated int64 | rhs contracting dimension numbers |